ĄĄ

Ą°ÖĮÄÜŧŊ°ē·ĀđØžüžžĘõÓëÏĩÍģĄąŅÝĘū

ĄĄ |

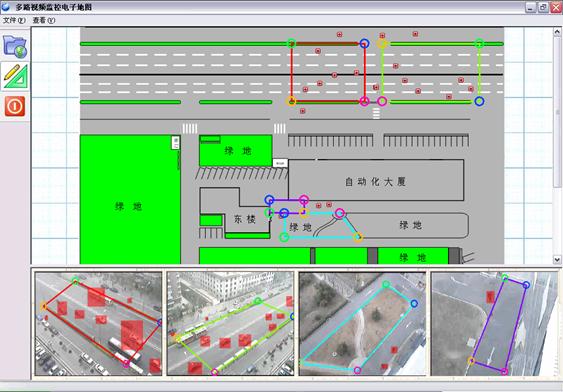

1. ―üšėÍâĩÄČËÁģÉí·ÝĘķąðžžĘõšÍÏĩÍģ |

|

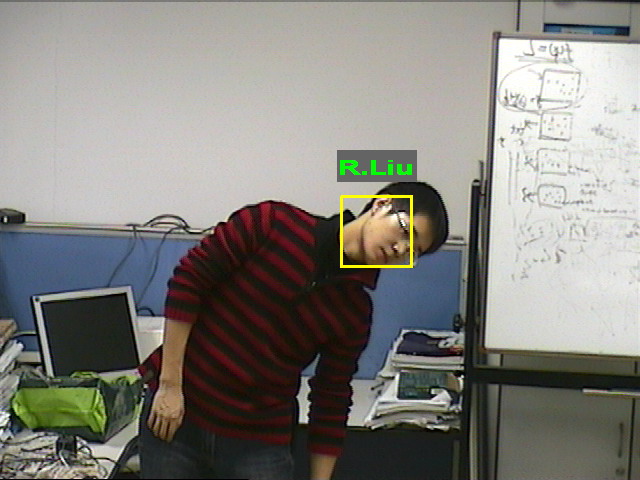

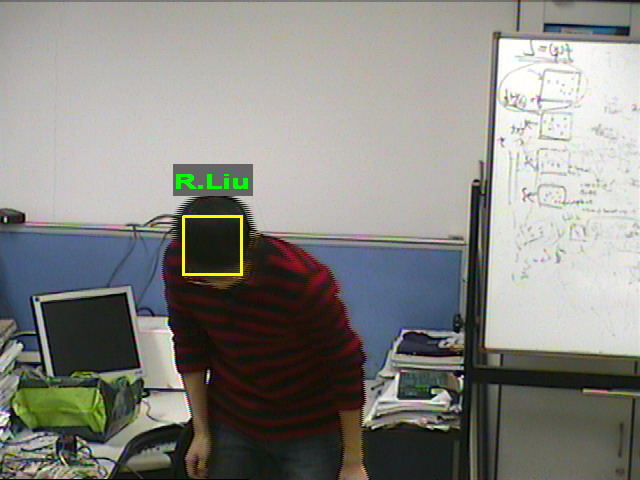

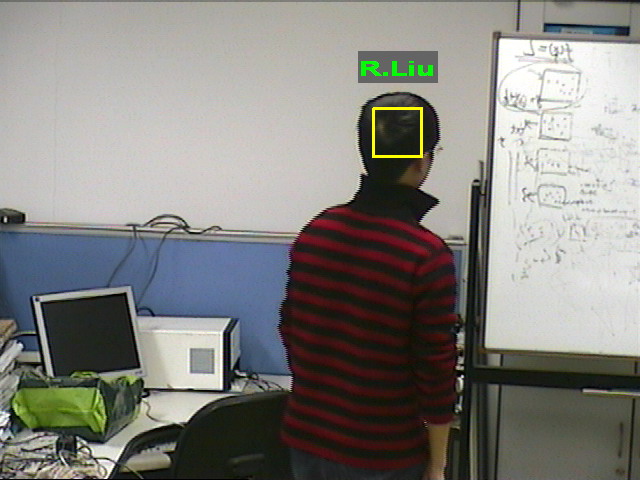

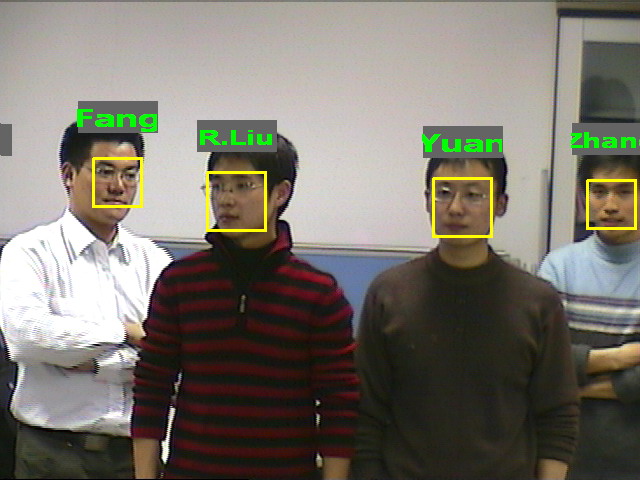

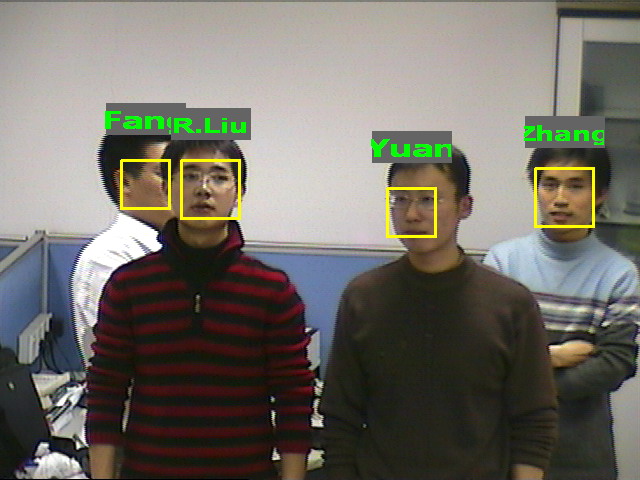

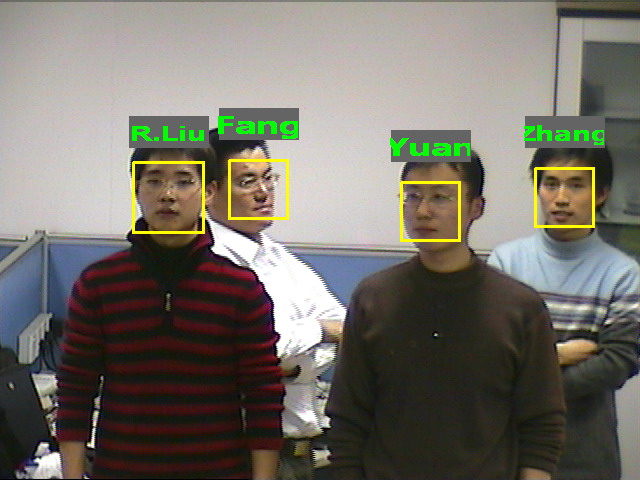

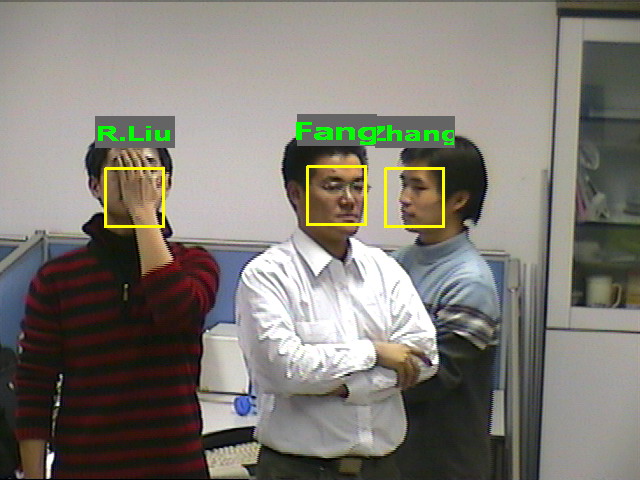

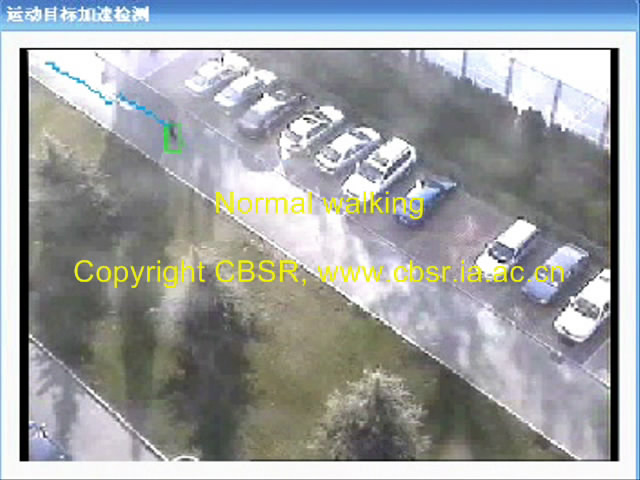

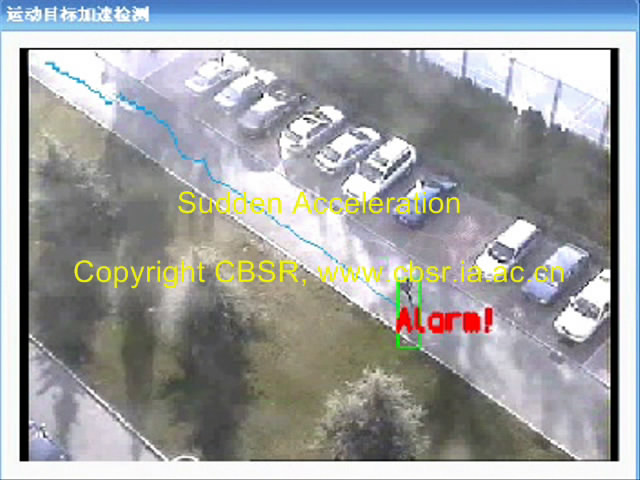

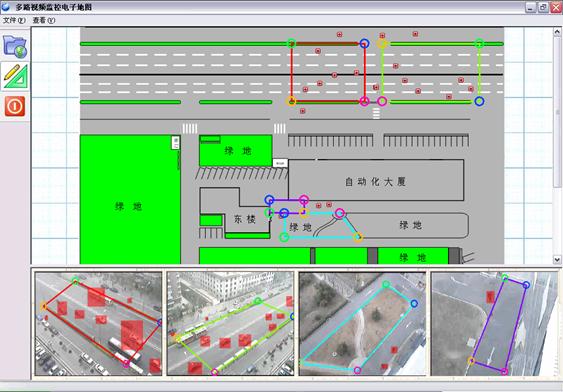

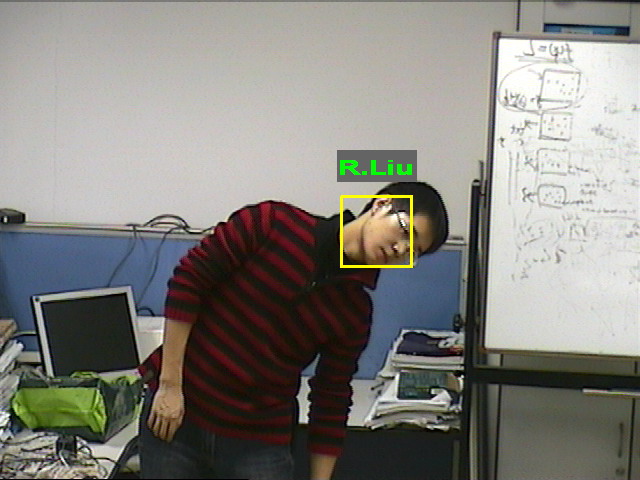

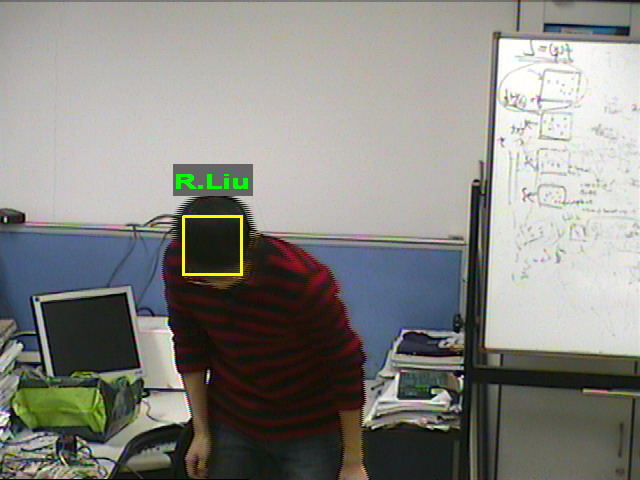

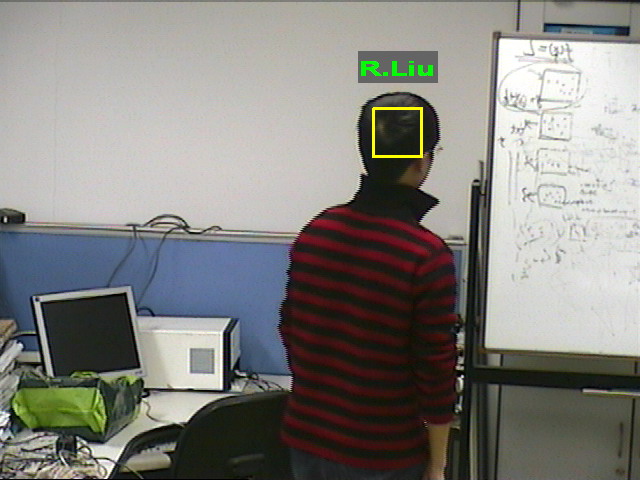

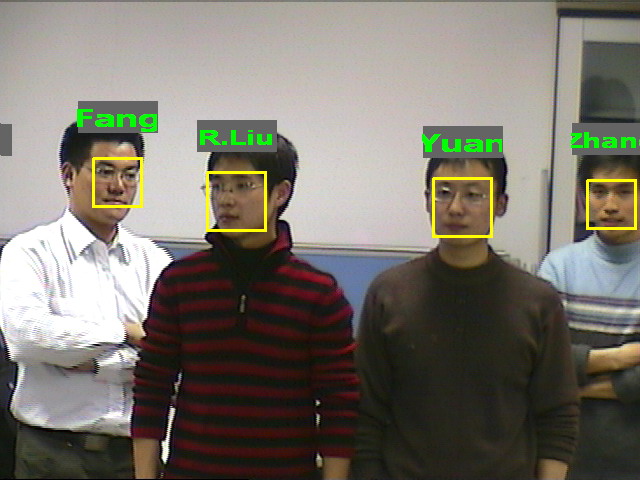

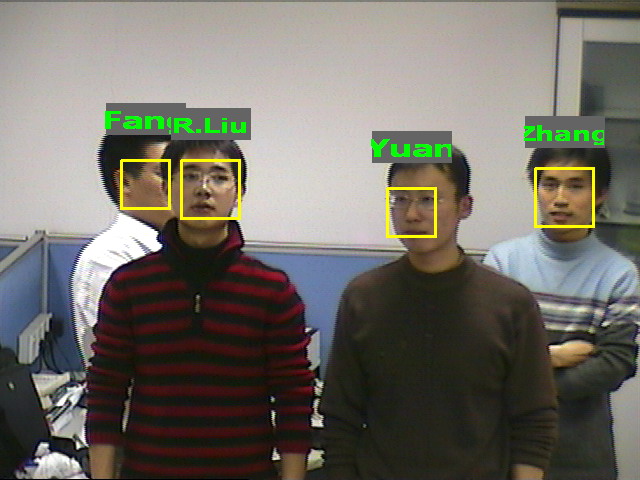

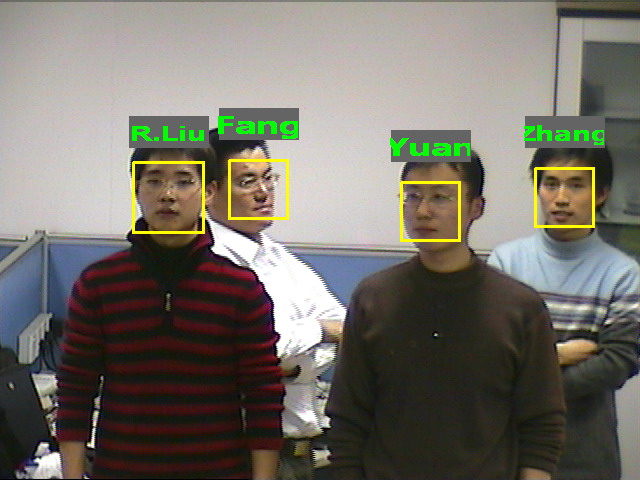

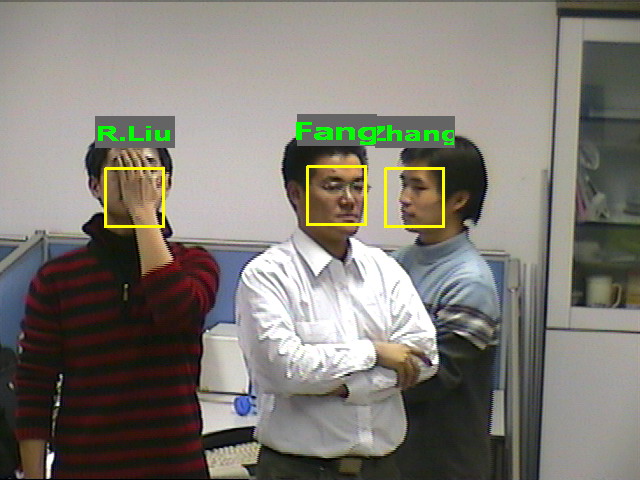

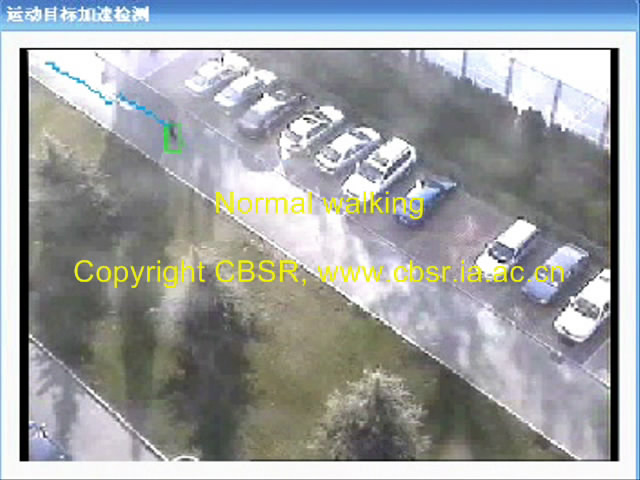

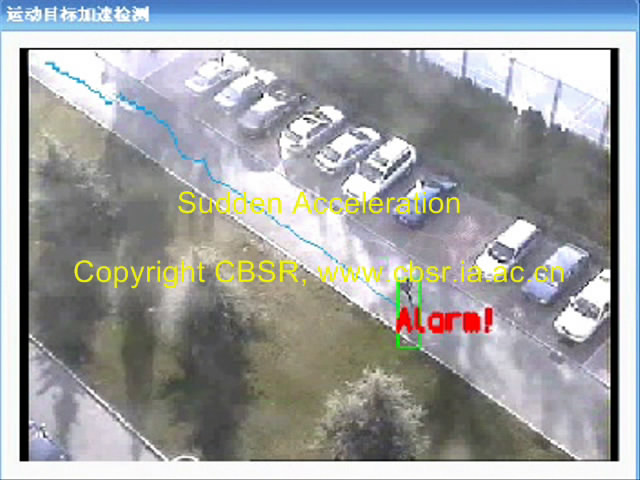

ĘÓÆĩŅÝĘū1 ĘÓÆĩŅÝĘū2 ŅÝĘūąūÏĩÍģĩÄķĀīīĩÄŧųÓÚ―üšėÍâÍžÏņĩÄČËÁģĘķąð·―·ĻšÍšËÐÄžžĘõĢŽ―âūöÁË°ē·ĀžāŋØÖÐēŧÍŽŧ·ūģđâÕÕÏÂŨžČ·ĩÄČËÁģĘķąðÎĘĖâĄĢÄŋĮ°ĘÐģĄÉÏĩÄČËÁģĘķąðžžĘõēúÆ·ĄĢģýÁËžÛļņ°šđóĩÄ3ÎŽČËÁģžžĘõēúÆ·ÍâĢŽŧųąūķžĘĮŧųÓÚŋÉžûđâÍžÏņĩÄĄĢķøŧųÓÚŋÉžûđâÍžÏņĩÄČËÁģĘķąðžžĘõķÔŧ·ūģđâĩÄÓ°ÏėÓÐŨÅÄŅŌÔŋË·þĩÄČąÏÝĢŽĩąĘķąðĘąĩÄŧ·ūģđâÓëŨĒēáĘąĩÄēŧÍŽĢŽĘķąðÐÔÄÜŧáÓÐ―ÏīóÏÂ―ĩĢŽÎÞ·ĻÂúŨãĘĩžĘÏĩÍģĩÄÐčŌŠĄĢČįšÎÏûģýŧ·ūģđâÕÕķÔČËÁģĘķąðĩÄÓ°ÏėģÉÁËĀ§ČÅČËÁģĘķąðÁėÓōĩÄŨîūßĖôÕ―ÐÔĩÄÄŅĖâĄĢĘÓÆĩŅÝĘūđē·ÖÎåēŋ·ÖÄÚČÝĄĢĩÚŌŧēŋ·ÖĢŽ―éÉÜžžĘõšÍÏĩÍģĩÄļÅŋöĢŧļÃÏĩÍģ°üĀĻŌŧĖĻ·þÎņÆũšÍķāļöÎŧÓÚēŧÍŽÎŧÖÃĩÄČËÁģĘķąðÖÕķËĄĢĩÚķþēŋ·ÖĢŽÏĩÍģÔÚÕýģĢđâÏßÏÂĩÄČËÁģĘķąðđýģĖĢŽÃŋļöČËÃæķÔÉãÏņŧúąĻģöŨÔžšĩÄÐÕÃûĢŽÏĩÍģķÔļÃČËÁģĘķąðšóąĻģöĘķąð―áđûÐÕÃûĄĢĩÚČýēŋ·ÖĢŽÏĩÍģÄÜđŧŨžČ·ĩØūÜūøÎīŨĒēáĩÄČËÔąĄĢĩÚËÄēŋ·ÖĢŽŨĒēáÐÂÓÃŧ§ĩÄđýģĖĄĢĩÚÎåēŋ·ÖĢŽÏĩÍģÔÚŧč°ĩĩÆđâÏÂ―øÐÐČËÁģĘķąðĢŽÕâēŋ·ÖŅÝĘūÄÚČÝÖÐĩÄđâÏßŧ·ūģĢŽķÔīŦÍģŧųÓÚŋÉžûđâÍžÏņĩÄČËÁģĘķąðËã·ĻĘĮļöšÜīóĩÄĖôÕ―ĢŽķøąūÏĩÍģÍęČŦēŧĘÜđâÏßąäŧŊĩÄÓ°ÏėĢŽ―âūöÁËĀ§ČÅČËÁģĘķąðÁėÓōĩÄŧ·ūģđâÕÕÓ°ÏėÎĘĖâĄĢ ĘÓÆĩŅÝĘū1 ĘÓÆĩŅÝĘū2 ŅÝĘūąūÏĩÍģĩÄķĀīīĩÄŧųÓÚ―üšėÍâÍžÏņĩÄČËÁģĘķąð·―·ĻšÍšËÐÄžžĘõĢŽ―âūöÁË°ē·ĀžāŋØÖÐēŧÍŽŧ·ūģđâÕÕÏÂŨžČ·ĩÄČËÁģĘķąðÎĘĖâĄĢÄŋĮ°ĘÐģĄÉÏĩÄČËÁģĘķąðžžĘõēúÆ·ĄĢģýÁËžÛļņ°šđóĩÄ3ÎŽČËÁģžžĘõēúÆ·ÍâĢŽŧųąūķžĘĮŧųÓÚŋÉžûđâÍžÏņĩÄĄĢķøŧųÓÚŋÉžûđâÍžÏņĩÄČËÁģĘķąðžžĘõķÔŧ·ūģđâĩÄÓ°ÏėÓÐŨÅÄŅŌÔŋË·þĩÄČąÏÝĢŽĩąĘķąðĘąĩÄŧ·ūģđâÓëŨĒēáĘąĩÄēŧÍŽĢŽĘķąðÐÔÄÜŧáÓÐ―ÏīóÏÂ―ĩĢŽÎÞ·ĻÂúŨãĘĩžĘÏĩÍģĩÄÐčŌŠĄĢČįšÎÏûģýŧ·ūģđâÕÕķÔČËÁģĘķąðĩÄÓ°ÏėģÉÁËĀ§ČÅČËÁģĘķąðÁėÓōĩÄŨîūßĖôÕ―ÐÔĩÄÄŅĖâĄĢĘÓÆĩŅÝĘūđē·ÖÎåēŋ·ÖÄÚČÝĄĢĩÚŌŧēŋ·ÖĢŽ―éÉÜžžĘõšÍÏĩÍģĩÄļÅŋöĢŧļÃÏĩÍģ°üĀĻŌŧĖĻ·þÎņÆũšÍķāļöÎŧÓÚēŧÍŽÎŧÖÃĩÄČËÁģĘķąðÖÕķËĄĢĩÚķþēŋ·ÖĢŽÏĩÍģÔÚÕýģĢđâÏßÏÂĩÄČËÁģĘķąðđýģĖĢŽÃŋļöČËÃæķÔÉãÏņŧúąĻģöŨÔžšĩÄÐÕÃûĢŽÏĩÍģķÔļÃČËÁģĘķąðšóąĻģöĘķąð―áđûÐÕÃûĄĢĩÚČýēŋ·ÖĢŽÏĩÍģÄÜđŧŨžČ·ĩØūÜūøÎīŨĒēáĩÄČËÔąĄĢĩÚËÄēŋ·ÖĢŽŨĒēáÐÂÓÃŧ§ĩÄđýģĖĄĢĩÚÎåēŋ·ÖĢŽÏĩÍģÔÚŧč°ĩĩÆđâÏÂ―øÐÐČËÁģĘķąðĢŽÕâēŋ·ÖŅÝĘūÄÚČÝÖÐĩÄđâÏßŧ·ūģĢŽķÔīŦÍģŧųÓÚŋÉžûđâÍžÏņĩÄČËÁģĘķąðËã·ĻĘĮļöšÜīóĩÄĖôÕ―ĢŽķøąūÏĩÍģÍęČŦēŧĘÜđâÏßąäŧŊĩÄÓ°ÏėĢŽ―âūöÁËĀ§ČÅČËÁģĘķąðÁėÓōĩÄŧ·ūģđâÕÕÓ°ÏėÎĘĖâĄĢ

ÖÐŋÆ°ÂÉ ARM9 ĮķČëĘ― ŧųÓÚARM9ĮķČëĘ―ÏĩÍģĩÄÖÐŋÆ°ÂÉČËÁģĘķąðÏĩÍģ ÖÐŋÆ°ÂÉ ARM9 ĮķČëĘ― ŧųÓÚARM9ĮķČëĘ―ÏĩÍģĩÄÖÐŋÆ°ÂÉČËÁģĘķąðÏĩÍģ

|

ĄĄ |

ĄĄ

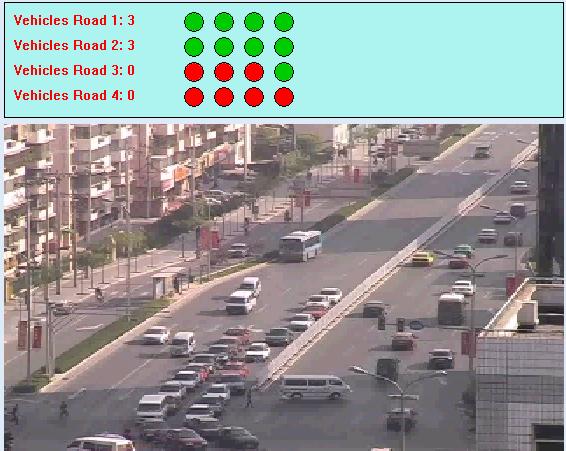

2.ÖÐÔķūāĀëČËÁģĘķąðÏĩÍģ |

|

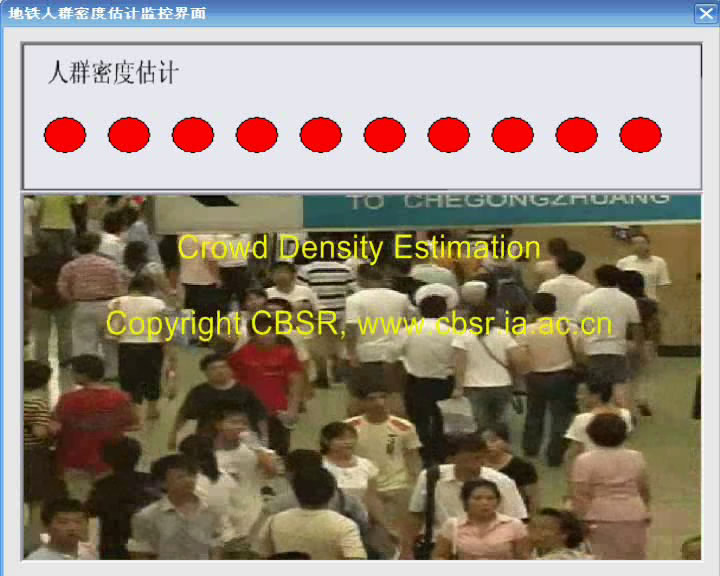

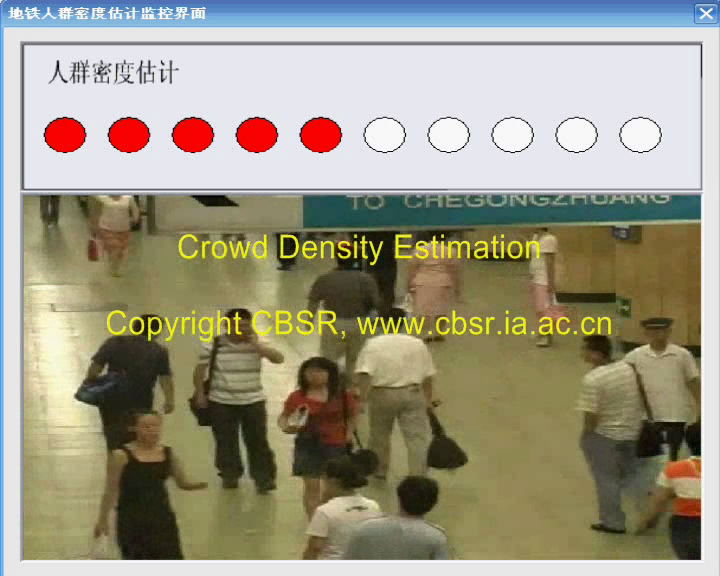

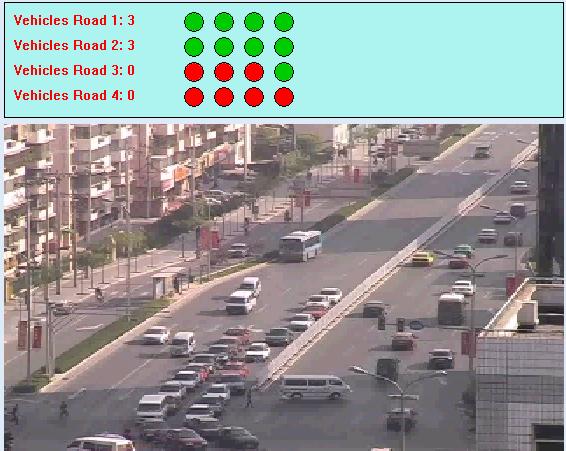

ĘÓÆĩÏÂÔØ īóķāĘýČËÁģĘķąðÏĩÍģķžĘĮ―üūāĀëÓÃŧ§ŋÉŌÔÖũķŊÅäšÏĩÄĘķąðÏĩÍģĄĢÎŌÃĮĘĩÏÖĩÄÖÐÔķūāĀëČËÁģļúŨŲšÍĘķąðžžĘõŋÉÔÚÖÐÔķūāĀëČËĖåŨËĖŽÏāķÔŨÔÓÉĖõžþÏÂ―øÐÐČËÁģļúŨŲšÍĘķąðĄĢËųÓКËÐÄžžĘõČŦēŋūßÓÐÍęČŦŨÔÖũÖŠĘķēúČĻĄĢūßĖåĩØĢŽŋÉÔÚČËÁģÍžÏņ·ÖąæÂĘ―ÏĩÍĄĒģĄū°ļīÔÓķāąäĄĒķāŨËĖŽĄĒČËÔąÏāŧĨÕÚĩēĩČļīÔÓĮéÐÎÏÂŋėËŲĩØĄĒŨžČ·ĩØĄĒĘĩĘąĩØžėēâĄĒļúŨŲšÍĘķąðķāļöČËÁģĄĢļÃÏĩÍģŧđŋÉŌÔķÔČËÁģ―øÐÐÖũķŊļúŨŲĢŽŌēŋÉĖáđĐÔÚÏßŨĒēáđĶÄÜĢŽēĒÄÜÕëķÔģĄū°ÄÚ·Į·ĻČËÔąĖáđĐąĻūŊÐÅÏĒĩČĄĢÏĩÍģĩÄĖØĩãĘĮĢšÄÜÔÚŅöÍ·ĄĒļĐÍ·ĄĒēāÉíĄĒąģÉíĄĒĖøÔūŨīĖŽÏÂąĢģÖļúŨŲĢŧÖÐÔķūāĀëČËÁģžėēâÂĘīóÓÚ99%ĢĻūāĀë6ÃŨĢĐĢŧÖÐÔķūāĀëČËÁģĘķąðÂĘīóÓÚ 95%ĢŧÄÜĘĩĘąĘķąðķāČËĄĢÄŋĮ°ÔÚ―ĖÓýÏĩÍģÓÐÖØŌŠÓĶÓÃĄĢ ĘÓÆĩÏÂÔØ īóķāĘýČËÁģĘķąðÏĩÍģķžĘĮ―üūāĀëÓÃŧ§ŋÉŌÔÖũķŊÅäšÏĩÄĘķąðÏĩÍģĄĢÎŌÃĮĘĩÏÖĩÄÖÐÔķūāĀëČËÁģļúŨŲšÍĘķąðžžĘõŋÉÔÚÖÐÔķūāĀëČËĖåŨËĖŽÏāķÔŨÔÓÉĖõžþÏÂ―øÐÐČËÁģļúŨŲšÍĘķąðĄĢËųÓКËÐÄžžĘõČŦēŋūßÓÐÍęČŦŨÔÖũÖŠĘķēúČĻĄĢūßĖåĩØĢŽŋÉÔÚČËÁģÍžÏņ·ÖąæÂĘ―ÏĩÍĄĒģĄū°ļīÔÓķāąäĄĒķāŨËĖŽĄĒČËÔąÏāŧĨÕÚĩēĩČļīÔÓĮéÐÎÏÂŋėËŲĩØĄĒŨžČ·ĩØĄĒĘĩĘąĩØžėēâĄĒļúŨŲšÍĘķąðķāļöČËÁģĄĢļÃÏĩÍģŧđŋÉŌÔķÔČËÁģ―øÐÐÖũķŊļúŨŲĢŽŌēŋÉĖáđĐÔÚÏßŨĒēáđĶÄÜĢŽēĒÄÜÕëķÔģĄū°ÄÚ·Į·ĻČËÔąĖáđĐąĻūŊÐÅÏĒĩČĄĢÏĩÍģĩÄĖØĩãĘĮĢšÄÜÔÚŅöÍ·ĄĒļĐÍ·ĄĒēāÉíĄĒąģÉíĄĒĖøÔūŨīĖŽÏÂąĢģÖļúŨŲĢŧÖÐÔķūāĀëČËÁģžėēâÂĘīóÓÚ99%ĢĻūāĀë6ÃŨĢĐĢŧÖÐÔķūāĀëČËÁģĘķąðÂĘīóÓÚ 95%ĢŧÄÜĘĩĘąĘķąðķāČËĄĢÄŋĮ°ÔÚ―ĖÓýÏĩÍģÓÐÖØŌŠÓĶÓÃĄĢ

|

ĄĄ |

ĄĄ

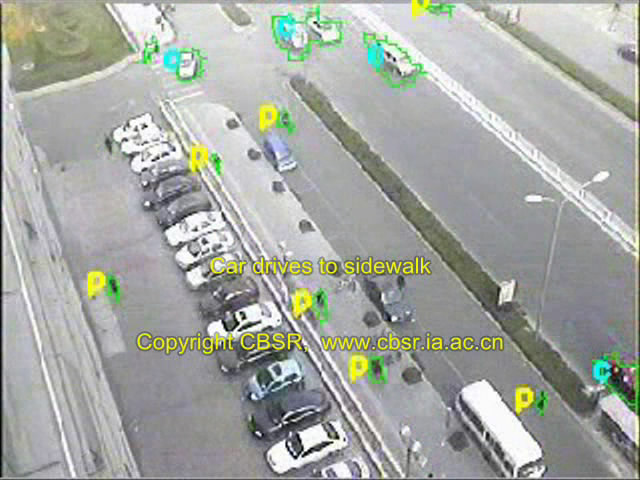

3. ČËÁģžėēâÓëļúŨŲ |

|

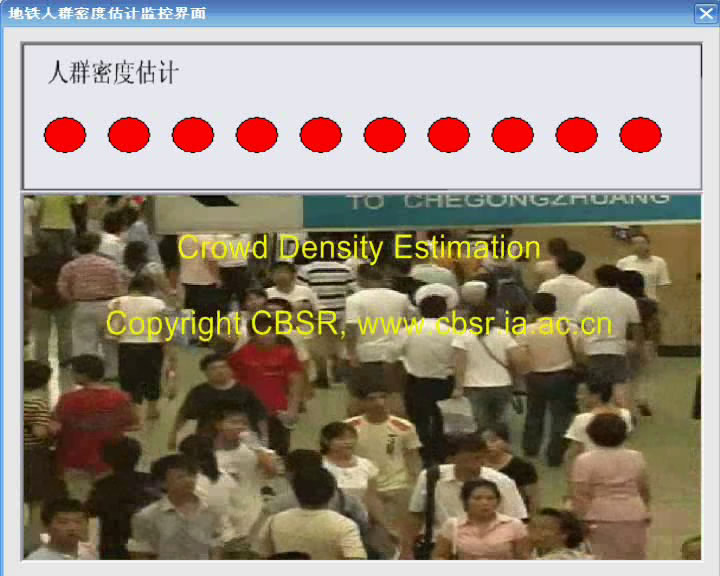

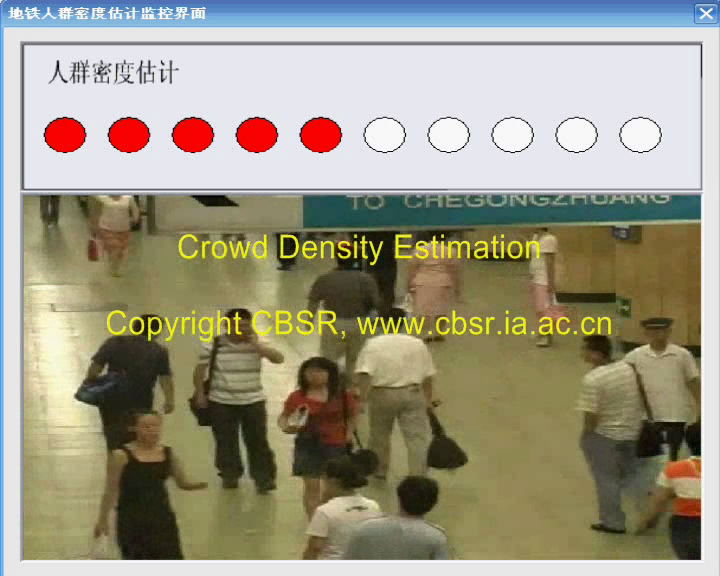

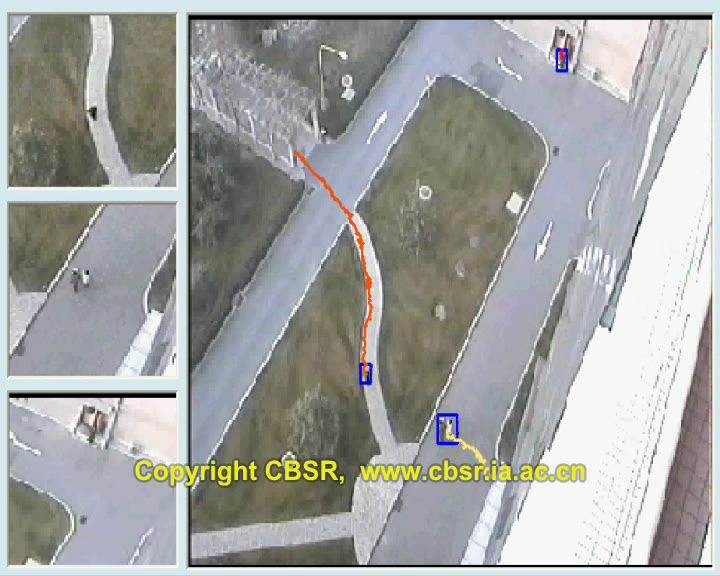

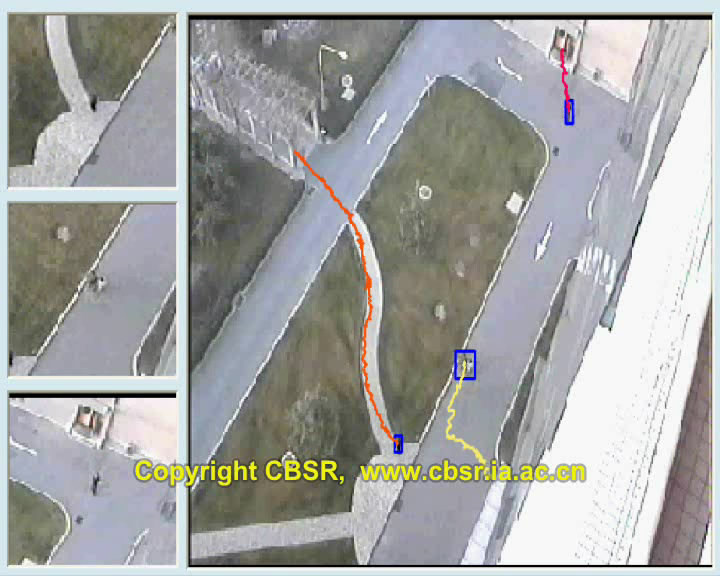

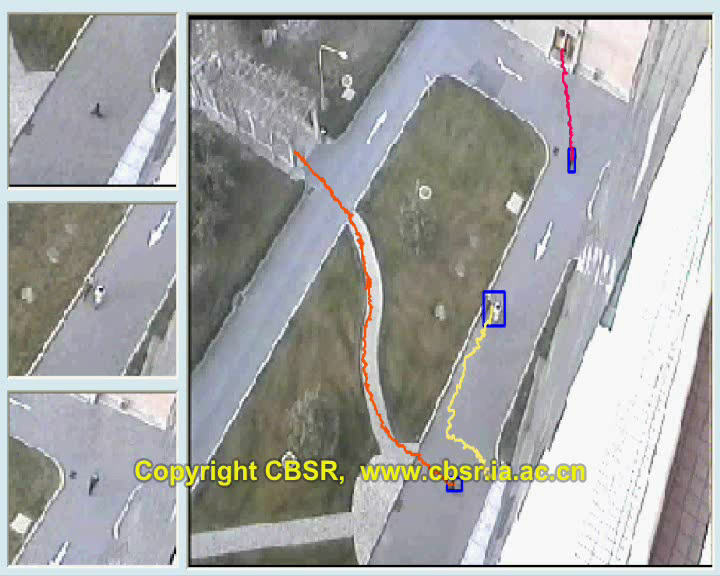

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄŨžČ·ĄĒÎČķĻĄĒĘĩĘąšÍÁũģĐĩÄČËÁģļúŨŲđØžüžžĘõĄĢÏÖÓÐČËÁģļúŨŲžžĘõŧųÓÚ·ôÉŦŧōąíÏóĢŽÔÚēāÁģŧōÁģēŋąŧÕÚĩēĩČĮéŋöÏÂĢŽÍųÍųļúŨŲķŠĘ§ĢŽÕâĘĮÐčŌŠ―âūöĩÄŌŧļöÎĘĖâĄĢÕâÏîđØžüžžĘõŋÉŌÔÔÚļīÔÓŧ·ūģÏÂĢŽēÉÓÃÆÕÍĻÉãÏņÍ·ĢĻūēÖđŧōÕßÔËķŊĢĐķÔČËÁģ―øÐÐĘĩĘąŨžČ·ĩØžėēâšÍļúŨŲĄĢŅÝĘū·ÖČýļöēŋ·ÖĢŽÃŋŌŧēŋ·ÖÂĖÉŦĘŪŨÖŋōąíĘūČËÁģžėēâĩÄ―áđûĢŽšėÉŦĘŪŨÖŋōąíĘūĮÐŧŧĩ―ČËÁģļúŨŲÄĢŋéĄĢĩÚŌŧēŋ·ÖĘĮđĖķĻÉãÏņŧúÏÂķāŨËĖŽŌÔž°ĖøÔūŨīĖŽÏÂĩÄČËÁģžėēâšÍļúŨŲĢŽÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢĩĨļöČË―øČëģĄū°ĢŽŌÔšÜīóĩÄ―ĮķČÉÏÏÂŨóÓŌēŧķÏļÄąäÁģĩÄŨËĖŽĢŽÍŽĘąÉíĖåŌēÓÐŋėËŲĩÄĖøÔūĄĢÔÚÕâÐĐļīÔÓĖõžþÏÂĢŽÏĩÍģÄÜđŧąĢģÖķÔČËÁģĩÄļúŨŲĢŽ―øÐÐÁËÏāÓĶĩÄąęķĻĄĢĩÚķþēŋ·ÖĘĮđĖķĻÉãÏņŧúÏÂķāļöČËÁģĩÄžėēâÓëļúŨŲĢŽÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢŋŠĘžĘĮŌŧļöČËĢŽČŧšóÔöžÓĩ―Á―ļöĢŽŨîšóĘĮËÄļöĢŽÏĩÍģŋÉŌÔŨÔķŊŨžČ·ĩØžėēâģöÕâÐĐČËÁģĢŽēĒąĢģÖļúŨŲĄĢĩÚČýēŋ·ÖĘĮÖũķŊÉãÏņŧúķÔČËÁģžėēâšÍļúŨŲĄĢÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢŌŧļöČË―øČëģĄū°ĢŽÏĩÍģžėēâģöČËÁģĢŽÖũķŊÉãÏņŧúËøķĻČËÁģĢŽÔÚÆäÔËķŊđýģĖÖÐąĢģÖļúŨŲĢŽÖąÖÁļÃČËĀëŋŠ·ŋžäĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄŨžČ·ĄĒÎČķĻĄĒĘĩĘąšÍÁũģĐĩÄČËÁģļúŨŲđØžüžžĘõĄĢÏÖÓÐČËÁģļúŨŲžžĘõŧųÓÚ·ôÉŦŧōąíÏóĢŽÔÚēāÁģŧōÁģēŋąŧÕÚĩēĩČĮéŋöÏÂĢŽÍųÍųļúŨŲķŠĘ§ĢŽÕâĘĮÐčŌŠ―âūöĩÄŌŧļöÎĘĖâĄĢÕâÏîđØžüžžĘõŋÉŌÔÔÚļīÔÓŧ·ūģÏÂĢŽēÉÓÃÆÕÍĻÉãÏņÍ·ĢĻūēÖđŧōÕßÔËķŊĢĐķÔČËÁģ―øÐÐĘĩĘąŨžČ·ĩØžėēâšÍļúŨŲĄĢŅÝĘū·ÖČýļöēŋ·ÖĢŽÃŋŌŧēŋ·ÖÂĖÉŦĘŪŨÖŋōąíĘūČËÁģžėēâĩÄ―áđûĢŽšėÉŦĘŪŨÖŋōąíĘūĮÐŧŧĩ―ČËÁģļúŨŲÄĢŋéĄĢĩÚŌŧēŋ·ÖĘĮđĖķĻÉãÏņŧúÏÂķāŨËĖŽŌÔž°ĖøÔūŨīĖŽÏÂĩÄČËÁģžėēâšÍļúŨŲĢŽÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢĩĨļöČË―øČëģĄū°ĢŽŌÔšÜīóĩÄ―ĮķČÉÏÏÂŨóÓŌēŧķÏļÄąäÁģĩÄŨËĖŽĢŽÍŽĘąÉíĖåŌēÓÐŋėËŲĩÄĖøÔūĄĢÔÚÕâÐĐļīÔÓĖõžþÏÂĢŽÏĩÍģÄÜđŧąĢģÖķÔČËÁģĩÄļúŨŲĢŽ―øÐÐÁËÏāÓĶĩÄąęķĻĄĢĩÚķþēŋ·ÖĘĮđĖķĻÉãÏņŧúÏÂķāļöČËÁģĩÄžėēâÓëļúŨŲĢŽÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢŋŠĘžĘĮŌŧļöČËĢŽČŧšóÔöžÓĩ―Á―ļöĢŽŨîšóĘĮËÄļöĢŽÏĩÍģŋÉŌÔŨÔķŊŨžČ·ĩØžėēâģöÕâÐĐČËÁģĢŽēĒąĢģÖļúŨŲĄĢĩÚČýēŋ·ÖĘĮÖũķŊÉãÏņŧúķÔČËÁģžėēâšÍļúŨŲĄĢÏāÓĶģĄū°ÎŠÆÕÍĻ·ŋžäÄÚĄĢŌŧļöČË―øČëģĄū°ĢŽÏĩÍģžėēâģöČËÁģĢŽÖũķŊÉãÏņŧúËøķĻČËÁģĢŽÔÚÆäÔËķŊđýģĖÖÐąĢģÖļúŨŲĢŽÖąÖÁļÃČËĀëŋŠ·ŋžäĄĢ

|

ĄĄ |

4. ķāÄŋąęÕÚĩēļúŨŲ |

|

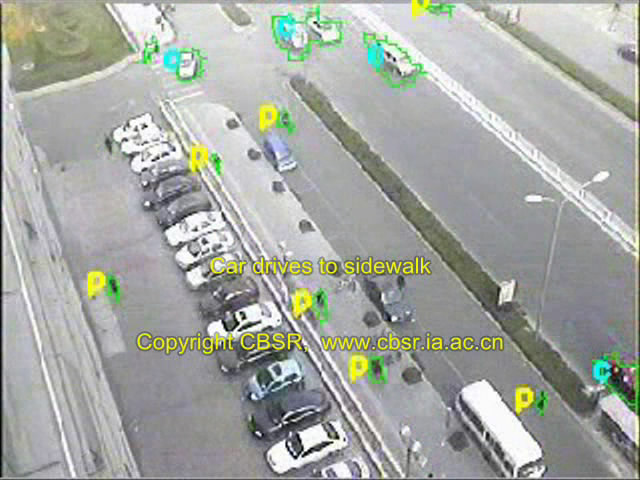

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķāÄŋąęÕÚĩēļúŨŲžžĘõĄĢŧĨÕÚĩēÏÖÏóĘĮļīÔÓģĄū°ÏÂÔËķŊķÔÏóļúŨŲÖÐģĢžûĩÄÎĘĖâĢŽŌēĘĮÓ°ÏėÏĩÍģÄÜ·ņŨžČ·ÓÐЧđĪŨũĩÄÖØĩãšÍÄŅĩãÄÚČÝÖŪŌŧĄĢąūÏĩÍģĀûÓÃŨÔÖũŋŠ·ĒĩÄžžĘõ―ÏšÃĩØīĶĀíÁËŧĨÕÚĩēļúŨŲÎĘĖâĄĢŅÝĘūđē·ÖËÄļöģĄū°ĄĢģĄū°ŌŧŅÝĘūĘŌÍâ―ŧÍĻģĄū°ÏÂÎŧÖÃŧĨÏāŋŋ―üĮŌÍâđÛŌŧÖÂĩÄģĩÁūĩÄŨžČ·ļúŨŲĄĢÏāÓĶģĄū°ÔÚÖÐđØīåķŦ·ĘĩĘąÅÄÉãĢŽģĄū°ÄÚģöÏÖÁ―ÁūšÚÉŦ―ÎģĩēĒÐÐĢŽŧĨÏāÓ°ÏėĢŽąūÏĩÍģŋÉŌÔąĢģÖķÔÁ―ģĩ·ÖąðŨžČ·ļúŨŲĢŽÖąÖÁÁ―ģĩ·ÖŋŠĄĢģĄū°ķþŅÝĘūĘŌÍâÔËķŊķÔÏó―ŧīíĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚÎũļņÂęīóÏÃĮ°ÍĢģĩģĄÅÄÉãĄĢģĄū°ÄÚķāīÎģöÏÖÐÐČËšÍģĩĢŽÐÐČËšÍÐÐČËÖŪžäĩÄ―ŧīíĢŽąūÏĩÍģŋÉŌÔŨžČ·ąĢģÖķÔÏāÓĶķÔÏóĩÄļúŨŲĄĢģĄū°ČýŌēĘĮŅÝĘūĘŌÍâÔËķŊķÔÏó―ŧīíĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚÄģ―ĖŅ§īóÂĨĮ°ÅÄÉãĄĢģĄū°ÄÚķāīÎģöÏÖÐÐČËšÍŨÔÐÐģĩĢŽÐÐČËšÍÐÐČËÖŪžäĩÄ―ŧīíĢŽąūÏĩÍģÄÜđŧŨžČ·ąĢģÖķÔÏāÓĶķÔÏóĩÄąęķĻĄĢģĄū°ËÄĘĮŅÝĘūĘŌÄÚČËŧĨÕÚĩēÔËķŊĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚĘĩŅéĘŌ·ŋžäÅÄÉãĄĢģĄū°ÄÚÁ―ļöČËŧĨÏā―ŧīíÐÐŨßĢŽķāīÎŧĨÏāÕÚĩēĢŽÕÚĩēĘąžäŌē―ÏģĪĢŽąūÏĩÍģÍŽŅųŋÉŌÔŨžČ·ąĢģÖķÔÁ―ļöČËĩÄŨžČ·ąęķĻĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķāÄŋąęÕÚĩēļúŨŲžžĘõĄĢŧĨÕÚĩēÏÖÏóĘĮļīÔÓģĄū°ÏÂÔËķŊķÔÏóļúŨŲÖÐģĢžûĩÄÎĘĖâĢŽŌēĘĮÓ°ÏėÏĩÍģÄÜ·ņŨžČ·ÓÐЧđĪŨũĩÄÖØĩãšÍÄŅĩãÄÚČÝÖŪŌŧĄĢąūÏĩÍģĀûÓÃŨÔÖũŋŠ·ĒĩÄžžĘõ―ÏšÃĩØīĶĀíÁËŧĨÕÚĩēļúŨŲÎĘĖâĄĢŅÝĘūđē·ÖËÄļöģĄū°ĄĢģĄū°ŌŧŅÝĘūĘŌÍâ―ŧÍĻģĄū°ÏÂÎŧÖÃŧĨÏāŋŋ―üĮŌÍâđÛŌŧÖÂĩÄģĩÁūĩÄŨžČ·ļúŨŲĄĢÏāÓĶģĄū°ÔÚÖÐđØīåķŦ·ĘĩĘąÅÄÉãĢŽģĄū°ÄÚģöÏÖÁ―ÁūšÚÉŦ―ÎģĩēĒÐÐĢŽŧĨÏāÓ°ÏėĢŽąūÏĩÍģŋÉŌÔąĢģÖķÔÁ―ģĩ·ÖąðŨžČ·ļúŨŲĢŽÖąÖÁÁ―ģĩ·ÖŋŠĄĢģĄū°ķþŅÝĘūĘŌÍâÔËķŊķÔÏó―ŧīíĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚÎũļņÂęīóÏÃĮ°ÍĢģĩģĄÅÄÉãĄĢģĄū°ÄÚķāīÎģöÏÖÐÐČËšÍģĩĢŽÐÐČËšÍÐÐČËÖŪžäĩÄ―ŧīíĢŽąūÏĩÍģŋÉŌÔŨžČ·ąĢģÖķÔÏāÓĶķÔÏóĩÄļúŨŲĄĢģĄū°ČýŌēĘĮŅÝĘūĘŌÍâÔËķŊķÔÏó―ŧīíĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚÄģ―ĖŅ§īóÂĨĮ°ÅÄÉãĄĢģĄū°ÄÚķāīÎģöÏÖÐÐČËšÍŨÔÐÐģĩĢŽÐÐČËšÍÐÐČËÖŪžäĩÄ―ŧīíĢŽąūÏĩÍģÄÜđŧŨžČ·ąĢģÖķÔÏāÓĶķÔÏóĩÄąęķĻĄĢģĄū°ËÄĘĮŅÝĘūĘŌÄÚČËŧĨÕÚĩēÔËķŊĘąĩÄļúŨŲĄĢÏāÓĶģĄū°ÔÚĘĩŅéĘŌ·ŋžäÅÄÉãĄĢģĄū°ÄÚÁ―ļöČËŧĨÏā―ŧīíÐÐŨßĢŽķāīÎŧĨÏāÕÚĩēĢŽÕÚĩēĘąžäŌē―ÏģĪĢŽąūÏĩÍģÍŽŅųŋÉŌÔŨžČ·ąĢģÖķÔÁ―ļöČËĩÄŨžČ·ąęķĻĄĢ

|

ĄĄ |

5. ÄŋąęžėēâĄĒļúŨŲĄĒÓë·ÖĀā |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄŨÔķŊÄŋąęžėēâĄĒļúŨŲšÍĘķąð·ÖĀāđĶÄÜĄĢļÃđĶÄÜ―ĻÁĒÔÚÄŋąęĖáČĄšÍļúŨŲĩÄŧųīĄÉÏĢŽÄÜđŧĘĩĘąķÔÔËķŊÄŋąęĩÄĀāÐÍ―øÐÐŨÔķŊŨžČ·ĘķąðĄĢÏĩÍģĘŨÏČēÉÓÃąģū°žõģýĩÄ·―·Ļ―øÐÐÔËķŊÎïĖåĩÄžėēâĢŽČŧšó―øÐÐļúŨŲĢŽžĮžļũļöÎïĖåĩÄÔËķŊđėžĢĢĻÔÚĘÓÆĩÖÐąęģöĢĐšÍÔËķŊÐÅÏĒĢĻ°üĀĻīóÐĄĢŽËŲÂĘĢŽ·―ÏōĩČĢĐĄĢÔÚŧņČĄÕâÐĐÐÅÏĒĩÄŧųīĄÉÏĢŽÏĩÍģķÔÃŋļöÔËķŊķÔÏó―øÐÐĘķąðĢŽÔÚÆäÅÔąßąęģöÏāÓĶĩÄĀāąðŨÖÄļĄĢļųūÝžāŋØģĄū°ĩÄĘĩžĘÐčŌŠĢŽÏĩÍģ―ŦģĄū°ÖÐĩÄÄŋąę·ÖΊÁųīóĀāĢšĩĨČËĄĒČšČËĄĒŨÔÐÐģĩĄĒÐĄ―ÎģĩĄĒÃæ°üģĩšÍŋĻģĩĄĢ ąūÏĩÍģÔÚ°ŨĖėÆÕÍĻÆøšōĖõžþÏÂĢŽĘŌÍâÔËķŊÄŋąęĘķąðĩÄŨžČ·ÂĘŋÉŌÔīïĩ―80%ŌÔÉÏĄĢÕâÏîžžĘõĩÄĖØĩãĘĮÓëÉãÏņŧúĘÓ―ĮĄĒÄŋąęŨËĖŽÎÞđØĢŽēĒÄÜĘĩÏÖĘĩĘąžėēâĄĒĘĩĘąļúŨŲšÍĘĩĘą·ÖĀāĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄŨÔķŊÄŋąęžėēâĄĒļúŨŲšÍĘķąð·ÖĀāđĶÄÜĄĢļÃđĶÄÜ―ĻÁĒÔÚÄŋąęĖáČĄšÍļúŨŲĩÄŧųīĄÉÏĢŽÄÜđŧĘĩĘąķÔÔËķŊÄŋąęĩÄĀāÐÍ―øÐÐŨÔķŊŨžČ·ĘķąðĄĢÏĩÍģĘŨÏČēÉÓÃąģū°žõģýĩÄ·―·Ļ―øÐÐÔËķŊÎïĖåĩÄžėēâĢŽČŧšó―øÐÐļúŨŲĢŽžĮžļũļöÎïĖåĩÄÔËķŊđėžĢĢĻÔÚĘÓÆĩÖÐąęģöĢĐšÍÔËķŊÐÅÏĒĢĻ°üĀĻīóÐĄĢŽËŲÂĘĢŽ·―ÏōĩČĢĐĄĢÔÚŧņČĄÕâÐĐÐÅÏĒĩÄŧųīĄÉÏĢŽÏĩÍģķÔÃŋļöÔËķŊķÔÏó―øÐÐĘķąðĢŽÔÚÆäÅÔąßąęģöÏāÓĶĩÄĀāąðŨÖÄļĄĢļųūÝžāŋØģĄū°ĩÄĘĩžĘÐčŌŠĢŽÏĩÍģ―ŦģĄū°ÖÐĩÄÄŋąę·ÖΊÁųīóĀāĢšĩĨČËĄĒČšČËĄĒŨÔÐÐģĩĄĒÐĄ―ÎģĩĄĒÃæ°üģĩšÍŋĻģĩĄĢ ąūÏĩÍģÔÚ°ŨĖėÆÕÍĻÆøšōĖõžþÏÂĢŽĘŌÍâÔËķŊÄŋąęĘķąðĩÄŨžČ·ÂĘŋÉŌÔīïĩ―80%ŌÔÉÏĄĢÕâÏîžžĘõĩÄĖØĩãĘĮÓëÉãÏņŧúĘÓ―ĮĄĒÄŋąęŨËĖŽÎÞđØĢŽēĒÄÜĘĩÏÖĘĩĘąžėēâĄĒĘĩĘąļúŨŲšÍĘĩĘą·ÖĀāĄĢ

|

ĄĄ |

6ĢŪŌėģĢķŊŨũžėēâ |

|

ĘÓÆĩÏÂÔØÓëÄŋąęŌėģĢÐÐΊ·ÖÎöēŧÍŽĢŽČËĖåŌėģĢķŊŨũĘķąðÓëąĻūŊÖũŌŠđØŨĒČËĩÄŌėģĢķŊŨũĄĢąČČįĢŽĩÅĖߥĒŌÆķŊÖØŌŠĩÄđŦÓÃÉčĘĐĄĒÂŌÐīÂŌŧĩČĄĢ ÔÚŅÐÖÆļÞžĘõĩÄđýģĖÖÐĢŽÎŌÃĮÍŧÆÆÁËīŦÍģĩÄŨö·ĻĢŽÁíŋŠÐ·ĢŽīïĩ―đúžĘÁėÏČËŪÆ―ĄĢļÃÏîžžĘõÓëĘÓ―ĮÎÞđØĢŽÓëģĄū°ÎÞđØĢŽÓëČËĩÄÍžÏņīóÐĄÎÞđØ , ÔËÐÐĘĩĘąÂģ°ôĄĢĩąÏĩÍģ·ĒÏÖČËĩÄŌėģĢķŊŨũĘąĢŽ ÏĩÍģÔÚÆäÖÜΧļøģöąĻūŊÐÅÏĒĢŽēĒ―øÐÐąĻūŊĄĢ ĘÓÆĩÏÂÔØÓëÄŋąęŌėģĢÐÐΊ·ÖÎöēŧÍŽĢŽČËĖåŌėģĢķŊŨũĘķąðÓëąĻūŊÖũŌŠđØŨĒČËĩÄŌėģĢķŊŨũĄĢąČČįĢŽĩÅĖߥĒŌÆķŊÖØŌŠĩÄđŦÓÃÉčĘĐĄĒÂŌÐīÂŌŧĩČĄĢ ÔÚŅÐÖÆļÞžĘõĩÄđýģĖÖÐĢŽÎŌÃĮÍŧÆÆÁËīŦÍģĩÄŨö·ĻĢŽÁíŋŠÐ·ĢŽīïĩ―đúžĘÁėÏČËŪÆ―ĄĢļÃÏîžžĘõÓëĘÓ―ĮÎÞđØĢŽÓëģĄū°ÎÞđØĢŽÓëČËĩÄÍžÏņīóÐĄÎÞđØ , ÔËÐÐĘĩĘąÂģ°ôĄĢĩąÏĩÍģ·ĒÏÖČËĩÄŌėģĢķŊŨũĘąĢŽ ÏĩÍģÔÚÆäÖÜΧļøģöąĻūŊÐÅÏĒĢŽēĒ―øÐÐąĻūŊĄĢ |

ĄĄ |

ĄĄ |

7. ČËŌėģĢÐÐΊžėēâÓëąĻūŊ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģČËÐÐΊŌėģĢąĻūŊĩÄđĶÄÜĄĢÏĩÍģÔÚĘĩĘąÂģ°ôĩÄÔËķŊžėēâĄĒļúŨŲšÍĘķąðĩÄŧųīĄÉÏĢŽķÔÎïĖåĩÄÔËķŊÐÅÏĒ―øÐÐ―øŌŧē―·ÖÎöĢŽĘĩÏÖÁËČËŌėģĢÐÐΊĩÄĘķąðÓëąĻūŊĄĢļÃŅÝĘūģĄū°ÔÚÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÍĢģĩģĄČëŋÚīĶĘĩĩØÅÄÉãĄĢŧÃæŨóēāÉÏ·―ÏÔĘūžāŋØģĄū°ž°īĶĀí―áđûĢŽÏ·―ĘĮĘĩĘąĖáČĄĩÄąģū°ŧÃæĄĢÏĩÍģĘŨÏČÍĻđýąģū°žõģýĖáČĄÔËķŊķÔÏóēĒ―øÐÐļúŨŲšÍÄŋąęĀāÐÍĘķąðĄĢĩąÓÐŌŧļöČËŋŋ―üĘÂÏČŧŪķĻĩÄ―ûĮøĢĻŧĻÆÔĢĐĘąĢŽÏĩÍģŨÔķŊÔÚļÃČËÖÜΧīōģöšėÉŦÎĘšÅĢŽŋŠĘžĘĮŌŧļöĢŽČŧšóĘĮÁ―ļöĄĢĩąļÃČËÕæĩÄ·Ô―ĀļļË―øČëŧĻÆÔĘąĢŽÏĩÍģÔÚÆäÖÜΧīōģöÁ―ļöūŠĖūšÅĢŽēĒ·ĒģöąĻūŊÉųĢŽąíĘūļÃČËĩÄÐÐΊŌėģĢĄĢÍŽĘąĢŽÏĩÍģ―ŦļÃČËĩÄūÖēŋģĄū°ÍžÏóĩĨķĀÏÔĘūÔÚŧÃæĩÄÓŌÉÏ·―ĢŽĘđđÜĀíČËÔąŋÉŌÔŨũ―üūāĀëđÛēâšÍÅÐķÏĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģČËÐÐΊŌėģĢąĻūŊĩÄđĶÄÜĄĢÏĩÍģÔÚĘĩĘąÂģ°ôĩÄÔËķŊžėēâĄĒļúŨŲšÍĘķąðĩÄŧųīĄÉÏĢŽķÔÎïĖåĩÄÔËķŊÐÅÏĒ―øÐÐ―øŌŧē―·ÖÎöĢŽĘĩÏÖÁËČËŌėģĢÐÐΊĩÄĘķąðÓëąĻūŊĄĢļÃŅÝĘūģĄū°ÔÚÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÍĢģĩģĄČëŋÚīĶĘĩĩØÅÄÉãĄĢŧÃæŨóēāÉÏ·―ÏÔĘūžāŋØģĄū°ž°īĶĀí―áđûĢŽÏ·―ĘĮĘĩĘąĖáČĄĩÄąģū°ŧÃæĄĢÏĩÍģĘŨÏČÍĻđýąģū°žõģýĖáČĄÔËķŊķÔÏóēĒ―øÐÐļúŨŲšÍÄŋąęĀāÐÍĘķąðĄĢĩąÓÐŌŧļöČËŋŋ―üĘÂÏČŧŪķĻĩÄ―ûĮøĢĻŧĻÆÔĢĐĘąĢŽÏĩÍģŨÔķŊÔÚļÃČËÖÜΧīōģöšėÉŦÎĘšÅĢŽŋŠĘžĘĮŌŧļöĢŽČŧšóĘĮÁ―ļöĄĢĩąļÃČËÕæĩÄ·Ô―ĀļļË―øČëŧĻÆÔĘąĢŽÏĩÍģÔÚÆäÖÜΧīōģöÁ―ļöūŠĖūšÅĢŽēĒ·ĒģöąĻūŊÉųĢŽąíĘūļÃČËĩÄÐÐΊŌėģĢĄĢÍŽĘąĢŽÏĩÍģ―ŦļÃČËĩÄūÖēŋģĄū°ÍžÏóĩĨķĀÏÔĘūÔÚŧÃæĩÄÓŌÉÏ·―ĢŽĘđđÜĀíČËÔąŋÉŌÔŨũ―üūāĀëđÛēâšÍÅÐķÏĄĢ

|

|

ĘÓÆĩÏÂÔØ ļÃĘÓÆĩÖũŌŠŅÝĘūąūÏĩÍģĩÄŌėģĢžÓËŲąĻūŊđĶÄÜĄĢÔÚŌŧÐĐÓĶÓÃģĄšÏÖÐĢŽÔËķŊÄŋąęĩÄŌėģĢžÓËŲÐÐΊĘĮÐčŌŠžÓŌÔŨĒŌâĩÄĢŽķÔÆäŨžČ·žėēâŋÉŌÔŨũΊ―ŧÍĻÎĨÕÂĢŽīģÔ――ûĮøĩČŌėģĢĘžþÅÐķÏĩÄŌĀūÝĄĢļÃŅÝĘūĩÄģĄū°ÎŠŨÔķŊŧŊËųÔ°ĮøĢŽŌŧļöÐÐČËÕýģĢē―ČëģĄū°ŌŧķÎĘąžäšóÍŧČŧžÓËŲąžÅÜĮ°―øĢŽÎŌÃĮ―ŦļÃÐÐΊķĻŌåžÓËŲŌėģĢĄĢÏĩÍģĀûÓÃÔËķŊžėēâšÍļúŨŲĖáđĐĩÄËŲķČĢŽžÓËŲķČĢŽđėžĢĩČÐÅÏĒĢŽŨžČ·ĩØžėēâĩ―ļÞÓËŲŌėģĢĢŽēĒÔÚÆäÖÜΧÏÔĘūÏāđØąĻūŊÐÅÏĒĄĢ ĘÓÆĩÏÂÔØ ļÃĘÓÆĩÖũŌŠŅÝĘūąūÏĩÍģĩÄŌėģĢžÓËŲąĻūŊđĶÄÜĄĢÔÚŌŧÐĐÓĶÓÃģĄšÏÖÐĢŽÔËķŊÄŋąęĩÄŌėģĢžÓËŲÐÐΊĘĮÐčŌŠžÓŌÔŨĒŌâĩÄĢŽķÔÆäŨžČ·žėēâŋÉŌÔŨũΊ―ŧÍĻÎĨÕÂĢŽīģÔ――ûĮøĩČŌėģĢĘžþÅÐķÏĩÄŌĀūÝĄĢļÃŅÝĘūĩÄģĄū°ÎŠŨÔķŊŧŊËųÔ°ĮøĢŽŌŧļöÐÐČËÕýģĢē―ČëģĄū°ŌŧķÎĘąžäšóÍŧČŧžÓËŲąžÅÜĮ°―øĢŽÎŌÃĮ―ŦļÃÐÐΊķĻŌåžÓËŲŌėģĢĄĢÏĩÍģĀûÓÃÔËķŊžėēâšÍļúŨŲĖáđĐĩÄËŲķČĢŽžÓËŲķČĢŽđėžĢĩČÐÅÏĒĢŽŨžČ·ĩØžėēâĩ―ļÞÓËŲŌėģĢĢŽēĒÔÚÆäÖÜΧÏÔĘūÏāđØąĻūŊÐÅÏĒĄĢ |

ĄĄ |

8ĢŪČËČšÃÜķČđĀžÆ

ĄĄ |

|

ĘÓÆĩÏÂÔØ1 ĘÓÆĩÏÂÔØ1  ĘÓÆĩÏÂÔØ2 ļÃĘÓÆĩÖũŌŠŅÝĘūąūÏĩÍģĩÄČËČšÃÜķČđĀžÆđĶÄÜĄĢđŦđēģĄËųĩÄČËČšÃÜķČđĀžÆĘĮ°ēČŦžāŋØĩÄŌŧļöÖØŌŠ·―ÃæĢŽķÔÓÚÐÖú―ŧÍĻđÜĀíĢŽŌėģĢÐÐΊĩÄąĻūŊĩČūßÓзĮģĢĘĩžĘĩÄŌâŌåĄĢļÃŅÝĘū°üĀĻÁ―ļöģĄū°ĢŽÃŋļöģĄū°ķžĘĮ―ŦČËČšÃÜķČ·ÖΊ 10 ļöĩČžķĀī―øÐÐđĀžÆĢŽēĒŌÔšėÉŦČĶąęžĮĢŽšėČĶÔ―ķāąíĘūČËČšÃÜķČÔ―īóĄĢģĄū°ŌŧĘĮĩØĖúÐōÁÐĢĻ RGB ĢŽ 640x480, 4 min 30 sec ĢŽÉãÏņŧúđĖķĻĢĐÔÚĩØĖúÎũÖąÃÅÕūēÉžŊĢŽžĮžÁËÁÐģĩ―øÕūĮ°ÕūĖĻČËąČ―ÏÉŲĩ―ÁÐģĩ―øÕūÏÂģĩĘąČËČšÓĩž·ĩ―ÁÐģĩĀëŋŠšóČËČšÖð―ĨÉĒČĨĩÄđýģĖĄĢģĄū°ķþĘĮŧðģĩÕūđãģĄÐōÁÐĢĻ RGB ĢŽ 640x480, 2 min 20 sec ĢŽÉãÏņŧúđĖķĻĢĐÔÚąąūĐÕūÄÏđãģĄēÉžŊĢŽÏĩÍģÄÜđŧąČ―ÏŨžČ·ĩØđĀžÆģöđãģĄÉÏČËČšÃÜķČĩÄąäŧŊĮéŋöĄĢļÃČËČšÃÜķČđĀžÆÏĩÍģÆ―ūųīĶĀíËŲķČÔž 10 ÖĄ / ÃëĢŽÄÜđŧÂúŨãĘĩĘąīĶĀíĩÄŌŠĮóĄĢ ĘÓÆĩÏÂÔØ2 ļÃĘÓÆĩÖũŌŠŅÝĘūąūÏĩÍģĩÄČËČšÃÜķČđĀžÆđĶÄÜĄĢđŦđēģĄËųĩÄČËČšÃÜķČđĀžÆĘĮ°ēČŦžāŋØĩÄŌŧļöÖØŌŠ·―ÃæĢŽķÔÓÚÐÖú―ŧÍĻđÜĀíĢŽŌėģĢÐÐΊĩÄąĻūŊĩČūßÓзĮģĢĘĩžĘĩÄŌâŌåĄĢļÃŅÝĘū°üĀĻÁ―ļöģĄū°ĢŽÃŋļöģĄū°ķžĘĮ―ŦČËČšÃÜķČ·ÖΊ 10 ļöĩČžķĀī―øÐÐđĀžÆĢŽēĒŌÔšėÉŦČĶąęžĮĢŽšėČĶÔ―ķāąíĘūČËČšÃÜķČÔ―īóĄĢģĄū°ŌŧĘĮĩØĖúÐōÁÐĢĻ RGB ĢŽ 640x480, 4 min 30 sec ĢŽÉãÏņŧúđĖķĻĢĐÔÚĩØĖúÎũÖąÃÅÕūēÉžŊĢŽžĮžÁËÁÐģĩ―øÕūĮ°ÕūĖĻČËąČ―ÏÉŲĩ―ÁÐģĩ―øÕūÏÂģĩĘąČËČšÓĩž·ĩ―ÁÐģĩĀëŋŠšóČËČšÖð―ĨÉĒČĨĩÄđýģĖĄĢģĄū°ķþĘĮŧðģĩÕūđãģĄÐōÁÐĢĻ RGB ĢŽ 640x480, 2 min 20 sec ĢŽÉãÏņŧúđĖķĻĢĐÔÚąąūĐÕūÄÏđãģĄēÉžŊĢŽÏĩÍģÄÜđŧąČ―ÏŨžČ·ĩØđĀžÆģöđãģĄÉÏČËČšÃÜķČĩÄąäŧŊĮéŋöĄĢļÃČËČšÃÜķČđĀžÆÏĩÍģÆ―ūųīĶĀíËŲķČÔž 10 ÖĄ / ÃëĢŽÄÜđŧÂúŨãĘĩĘąīĶĀíĩÄŌŠĮóĄĢ |

ĄĄ |

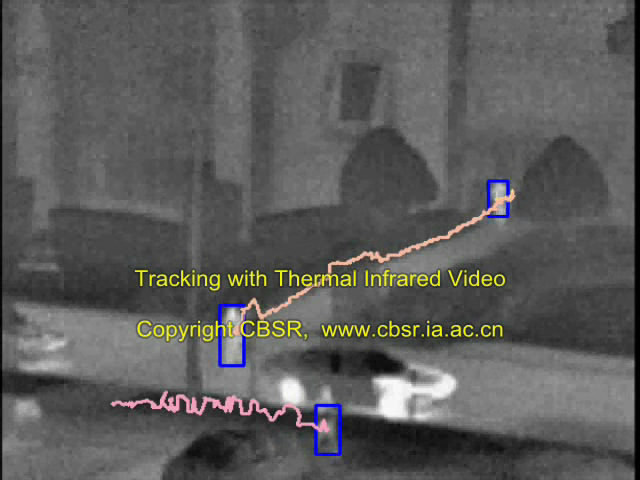

9ĢŪ―ŧÍĻģĩÁūžÆĘýŅÝĘū |

|

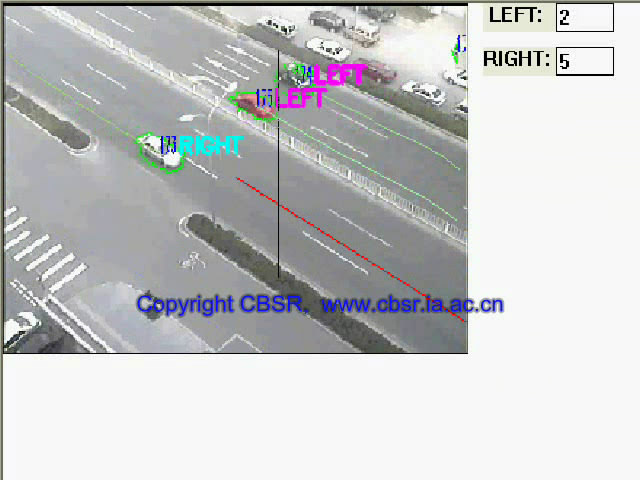

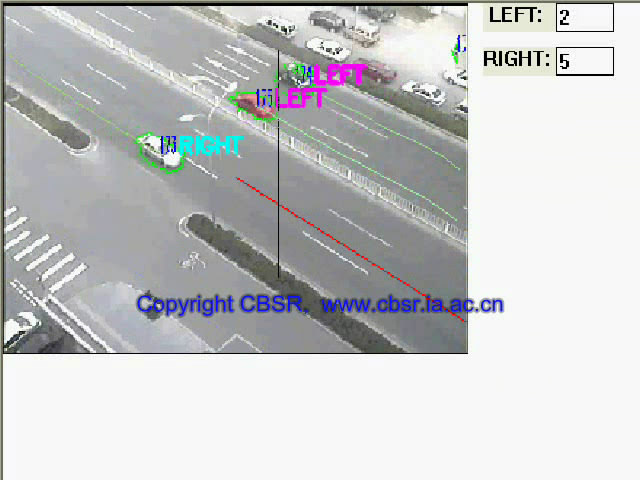

ĘÓÆĩÏÂÔØ ŅÝĘūąūÖĮÄÜžāŋØÏĩÍģĩÄ―ŧÍĻģĩÁūžÆĘýđĶÄÜĄĢÆÁÄŧŨó·―īóĮøÓōΊžāŋØģĄū°ĢŽÆÁÄŧÓŌÉÏ·―ΊŨóÓŌÁ―ģĩĩĀĩÄžÆĘý―áđûĄĢļÃŅÝĘūģĄū°ÎŠÖÐđØīåķŦ·ĘĩĩØÅÄÉãĄĢÏĩÍģĘŨÏČēÉÓÃąģū°žõģýžžĘõ―øÐÐÔËķŊģĩÁūĩÄžėēâšÍļúŨŲĢŽ―øķøžĮžģĩÁūĩÄÐÐĘŧđėžĢĄĢÔÚīËŧųīĄÉÏĢŽļųūÝķĻŌåĩÄŨøąęÏĩÍģĢŽ―ášÏÔËķŊđėžĢūÍŋÉŌÔÅÐķÏģöģĩÁūĩÄÐÐĘŧ·―ÏōĄĢÔÚžÆĘýĘąĢŽÎŌÃĮÖŧđØÐÄÂí·ÖũļÉĩĀÉÏĩÄģĩÁūĘýÄŋĢŽÔÚÍžÏņÖÐĩÄÏāÓĶÎŧÖÃŧģöŌŧĖõŧųŨžÏߥĢĩąģĩÁūŨÔŨóÏōÓŌÍĻđýļÃŧųŨžÏßĘąĢŽÓŌÉÏ·―ĩÄLEFTžÆĘýŋōŨÔķŊÔöžÓŌŧĄĢģĩÁūŨÔÓŌÏōŨóÍĻđýŧųŨžÏßĘąĩĀĀíÏāÍŽĄĢÔÚ°ŨĖėĄĒÆÕÍĻĖėÆøŌÔž°ģĩÁūÕýģĢÐÐĘŧĩÄĮéŋöÏÂĢŽļÃÏĩÍģŋÉŌÔīïĩ―90%ŌÔÉÏĩÄžÆĘýŨžČ·ÐÔĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÖĮÄÜžāŋØÏĩÍģĩÄ―ŧÍĻģĩÁūžÆĘýđĶÄÜĄĢÆÁÄŧŨó·―īóĮøÓōΊžāŋØģĄū°ĢŽÆÁÄŧÓŌÉÏ·―ΊŨóÓŌÁ―ģĩĩĀĩÄžÆĘý―áđûĄĢļÃŅÝĘūģĄū°ÎŠÖÐđØīåķŦ·ĘĩĩØÅÄÉãĄĢÏĩÍģĘŨÏČēÉÓÃąģū°žõģýžžĘõ―øÐÐÔËķŊģĩÁūĩÄžėēâšÍļúŨŲĢŽ―øķøžĮžģĩÁūĩÄÐÐĘŧđėžĢĄĢÔÚīËŧųīĄÉÏĢŽļųūÝķĻŌåĩÄŨøąęÏĩÍģĢŽ―ášÏÔËķŊđėžĢūÍŋÉŌÔÅÐķÏģöģĩÁūĩÄÐÐĘŧ·―ÏōĄĢÔÚžÆĘýĘąĢŽÎŌÃĮÖŧđØÐÄÂí·ÖũļÉĩĀÉÏĩÄģĩÁūĘýÄŋĢŽÔÚÍžÏņÖÐĩÄÏāÓĶÎŧÖÃŧģöŌŧĖõŧųŨžÏߥĢĩąģĩÁūŨÔŨóÏōÓŌÍĻđýļÃŧųŨžÏßĘąĢŽÓŌÉÏ·―ĩÄLEFTžÆĘýŋōŨÔķŊÔöžÓŌŧĄĢģĩÁūŨÔÓŌÏōŨóÍĻđýŧųŨžÏßĘąĩĀĀíÏāÍŽĄĢÔÚ°ŨĖėĄĒÆÕÍĻĖėÆøŌÔž°ģĩÁūÕýģĢÐÐĘŧĩÄĮéŋöÏÂĢŽļÃÏĩÍģŋÉŌÔīïĩ―90%ŌÔÉÏĩÄžÆĘýŨžČ·ÐÔĄĢ

|

ĄĄ |

10ĢŪÖũīÓÉãÏņŧúļúŨŲ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄÖũīÓļúŨŲžžĘõĄĢÔÚąūÏĩÍģēÉÓÃŌŧÖÖĀûÓÃĩĨļöÉãÏņŧúĘĩÏÖÖũīÓļúŨŲĩÄ·―·ĻĢŽÍĻđýŌŧļöļß·ÖąæÂĘÉãÏņŧúĢŽēÉÓÃÖũīÓ―áđđ―øÐÐĘÓÆĩļúŨŲĄĢÍĻđýķÔļß·ÖąæÂĘÉãÏņŧúēķŨ―ĩ―ĩÄÐÅšÅĩÄļßЧĀûÓÃĢŽķÔČËšÍģĩÁūĩÄÏļ―ÚŨũļß·ÖąæÂĘĩÄļúŨŲÓëđÛēâĢŽŌÔ―øŌŧē―ÏļÖÂĩØ·ÖÎöÓëÅÐķÏĄĢļÃŅÝĘūģĄū°ÔÚŨÔķŊŧŊËųÔ°ĮøÄÚĘĩĩØÅÄÉãĢŽŧÃæÓŌēāĘĮļßĮåÎúķČČŦū°ĢŽŧÃæŨóēāīÓÉÏĩ―ÏÂÁÐģöČýļö·ÅīóĩÄūÖēŋģĄū°ĄĢÏĩÍģĘŨÏČžėēâģöČŦū°ĀïĩÄÔËķŊķÔÏóēĒ―øÐÐļúŨŲĢŽÏāÓĶđėžĢÏÔĘūÔÚČŦū°ŧÃæĀïĄĢÍŽĘąŨÔķŊļųūÝąęšÅīóÐĄĢŽŧōÕßÓÉÓÃŧ§ÖļķĻĢŽÏĩÍģÔÚūÖēŋģĄū°ŧÃæÖзÅīóÏÔĘūČýļöÄŋĮ°ÕýÔÚąŧļúŨŲĩÄÔËķŊķÔÏóĢĻēŧŨãČýļöÔōÏāÓĶŧÃæČŦšÚĢĐĢŽŌÔąãÓÃŧ§ŨũģöÏļÖÂđÛēėšÍÅÐķÏĄĢļÞžĘõĩÄÓÅĩãÔÚÓÚĢŽĀûÓÃČížþĘĩÏÖūÖēŋķÔÏóļúŨŲĢŽŅĄÔņķāļöķÔÏó―øÐÐūÖēŋļúŨŲÓëŅĄÔņŌŧļöķÔÏóÏāąČĢŽÆäžÆËãŋŠÏúĘĮŧųąūēŧąäĩÄĢŽŋË·þÁËīŦÍģÖũīÓÉãÏņŧú·―°ļŋŠÏúīóšÍÄŅŌÔŋØÖÆĩÄČąÏÝĢŽēĒĮŌÏĩÍģžŊģÉķČļßĢŽÖÆÔėģÉąūĩÍĢŽ°ēŨ°ĄĒÎŽŧĪ·―ąãĮŌŨÔķŊŧŊģĖķČļߥĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄÖũīÓļúŨŲžžĘõĄĢÔÚąūÏĩÍģēÉÓÃŌŧÖÖĀûÓÃĩĨļöÉãÏņŧúĘĩÏÖÖũīÓļúŨŲĩÄ·―·ĻĢŽÍĻđýŌŧļöļß·ÖąæÂĘÉãÏņŧúĢŽēÉÓÃÖũīÓ―áđđ―øÐÐĘÓÆĩļúŨŲĄĢÍĻđýķÔļß·ÖąæÂĘÉãÏņŧúēķŨ―ĩ―ĩÄÐÅšÅĩÄļßЧĀûÓÃĢŽķÔČËšÍģĩÁūĩÄÏļ―ÚŨũļß·ÖąæÂĘĩÄļúŨŲÓëđÛēâĢŽŌÔ―øŌŧē―ÏļÖÂĩØ·ÖÎöÓëÅÐķÏĄĢļÃŅÝĘūģĄū°ÔÚŨÔķŊŧŊËųÔ°ĮøÄÚĘĩĩØÅÄÉãĢŽŧÃæÓŌēāĘĮļßĮåÎúķČČŦū°ĢŽŧÃæŨóēāīÓÉÏĩ―ÏÂÁÐģöČýļö·ÅīóĩÄūÖēŋģĄū°ĄĢÏĩÍģĘŨÏČžėēâģöČŦū°ĀïĩÄÔËķŊķÔÏóēĒ―øÐÐļúŨŲĢŽÏāÓĶđėžĢÏÔĘūÔÚČŦū°ŧÃæĀïĄĢÍŽĘąŨÔķŊļųūÝąęšÅīóÐĄĢŽŧōÕßÓÉÓÃŧ§ÖļķĻĢŽÏĩÍģÔÚūÖēŋģĄū°ŧÃæÖзÅīóÏÔĘūČýļöÄŋĮ°ÕýÔÚąŧļúŨŲĩÄÔËķŊķÔÏóĢĻēŧŨãČýļöÔōÏāÓĶŧÃæČŦšÚĢĐĢŽŌÔąãÓÃŧ§ŨũģöÏļÖÂđÛēėšÍÅÐķÏĄĢļÞžĘõĩÄÓÅĩãÔÚÓÚĢŽĀûÓÃČížþĘĩÏÖūÖēŋķÔÏóļúŨŲĢŽŅĄÔņķāļöķÔÏó―øÐÐūÖēŋļúŨŲÓëŅĄÔņŌŧļöķÔÏóÏāąČĢŽÆäžÆËãŋŠÏúĘĮŧųąūēŧąäĩÄĢŽŋË·þÁËīŦÍģÖũīÓÉãÏņŧú·―°ļŋŠÏúīóšÍÄŅŌÔŋØÖÆĩÄČąÏÝĢŽēĒĮŌÏĩÍģžŊģÉķČļßĢŽÖÆÔėģÉąūĩÍĢŽ°ēŨ°ĄĒÎŽŧĪ·―ąãĮŌŨÔķŊŧŊģĖķČļߥĢ

|

ĄĄ |

11ĢŪķāÉãÏņŧúĘýūÝČÚšÏĢĻČŦū°žāŋØĩØÍžĢĐ |

|

ĘÓÆĩÏÂÔØ ąūÏĩÍģĩÄČŦūÖžāŋØĩįŨÓĩØÍžđĶÄÜĄĢąūÏĩÍģēÉÓÃČŦū°žāŋØĩØÍžĩÄÐÎĘ――ŦÔÚ·ÖēžÔÚģĄū°ÖÐēŧÍŽĮøÓōĩÄÉãÏņŧúēÉžŊšÍ·ÖÎöĩÃĩ―ĩÄÔËķŊķÔÏóÐÅÏĒž°ĘąĩØÏÔĘūÔÚķþÎŽČŦū°žāŋØĩØÍžÉÏĢŽ―âūöÁËķāÉãÏņŧúÐÅÏĒČÚšÏÎĘĖâĢŽĘđĩÞāŋØđĪŨũČËÔąķÔČŦūÖÓÐĮåÎúĩÄ°ŅÎÕĄĢŅÝĘūģĄū°ĘĮÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÔ°ĮøËÄÖÜĄĢŧÃæŨóēāĮøÓōÏÔĘūĩÄĘĮČŦūÖķþÎŽĩįŨÓĩØÍžĢŽÓŌēāĘĮÁ―·ģĄū°ĢĻÔ°ĮøšÍÍĢģĩģĄĢĐĘÓÆĩĄĢÃŋ·ģĄū°·Öąð―øÐÐÔËķŊžėēâšÍļúŨŲĢŽĩÃĩ―ĩÄķÔÏóÎŧÖÃÐÅÏĒÍĻđýŌŧķĻĩÄžļšÎąäŧŧÍķÓ°ĩ―ĩįŨÓĩØÍžÉÏĄĢĩØÍžÉÏĩÄšėĩãĘĮÍĢģĩģĄÉÏÔËķŊÎïĖåĢŽĀķĩãĘĮÔ°ĮøÄÚĩÄÔËķŊÎïĖåĄĢÍŽĘąĢŽÁ―·ģĄū°ÖÐĩÄÔËķŊķÔÏóĩÄūÖēŋģĄū°·ÖąðÏÔĘūÔÚŧÃæÓŌÏ·―ĩÄÁ―ļöÐĄī°ŋÚÖÐĢŽ·―ąãÓÃŧ§―øÐÐ―üūāĀëĩÄđÛēâšÍÅÐķÏĄĢļÃČŦūÖĩįŨÓĩØÍžđĶÄÜĩÄĘĩÏÖīóīóĖáļßÁËÏĩÍģĩÄÐÅÏĒČÚšÏÄÜÁĶĄĢ ĘÓÆĩÏÂÔØ ąūÏĩÍģĩÄČŦūÖžāŋØĩįŨÓĩØÍžđĶÄÜĄĢąūÏĩÍģēÉÓÃČŦū°žāŋØĩØÍžĩÄÐÎĘ――ŦÔÚ·ÖēžÔÚģĄū°ÖÐēŧÍŽĮøÓōĩÄÉãÏņŧúēÉžŊšÍ·ÖÎöĩÃĩ―ĩÄÔËķŊķÔÏóÐÅÏĒž°ĘąĩØÏÔĘūÔÚķþÎŽČŦū°žāŋØĩØÍžÉÏĢŽ―âūöÁËķāÉãÏņŧúÐÅÏĒČÚšÏÎĘĖâĢŽĘđĩÞāŋØđĪŨũČËÔąķÔČŦūÖÓÐĮåÎúĩÄ°ŅÎÕĄĢŅÝĘūģĄū°ĘĮÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÔ°ĮøËÄÖÜĄĢŧÃæŨóēāĮøÓōÏÔĘūĩÄĘĮČŦūÖķþÎŽĩįŨÓĩØÍžĢŽÓŌēāĘĮÁ―·ģĄū°ĢĻÔ°ĮøšÍÍĢģĩģĄĢĐĘÓÆĩĄĢÃŋ·ģĄū°·Öąð―øÐÐÔËķŊžėēâšÍļúŨŲĢŽĩÃĩ―ĩÄķÔÏóÎŧÖÃÐÅÏĒÍĻđýŌŧķĻĩÄžļšÎąäŧŧÍķÓ°ĩ―ĩįŨÓĩØÍžÉÏĄĢĩØÍžÉÏĩÄšėĩãĘĮÍĢģĩģĄÉÏÔËķŊÎïĖåĢŽĀķĩãĘĮÔ°ĮøÄÚĩÄÔËķŊÎïĖåĄĢÍŽĘąĢŽÁ―·ģĄū°ÖÐĩÄÔËķŊķÔÏóĩÄūÖēŋģĄū°·ÖąðÏÔĘūÔÚŧÃæÓŌÏ·―ĩÄÁ―ļöÐĄī°ŋÚÖÐĢŽ·―ąãÓÃŧ§―øÐÐ―üūāĀëĩÄđÛēâšÍÅÐķÏĄĢļÃČŦūÖĩįŨÓĩØÍžđĶÄÜĩÄĘĩÏÖīóīóĖáļßÁËÏĩÍģĩÄÐÅÏĒČÚšÏÄÜÁĶĄĢ

|

ĄĄ |

12ĢŪ―ŧÍĻÓĩķžėēâÓëąĻūŊ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķāģĩĩĀģĩÁūžÆĘýšÍÓĩČû·ÖÎöđĶÄÜĄĢŧÃæ·ÖÉÏÏÂÁ―ŋéĢŽÏ·―ĘĮĘÓÆĩģĄū°ĢŽÉÏ·―ĘĮĘĩĘąĩÄ―áđûÏÔĘūĢŽÆäÖÐŨóąßĘĮģĩÁūžÆĘý―áđûĢŽÓŌąßĘĮÓĩČû·ÖÎöĩÄ―áđûĄĢļÃģĄū°ÔÚīóÖÓË·ŋÚĘĩĩØÅÄÉãĄĢąūŅÝĘūÕëķÔģĄū°ÖÐĩÄËÄļöÖũŌŠģĩĩĀÉÏÐÐĘđĩÄģĩÁū―øÐÐÍģžÆĢŽĘýÄŋÏÔĘūÔÚķÔÓĶī°ĖåÖÐĄĢļųūÝļũģĩĩĀĩÄžÆĘý―áđûĢŽ―ášÏķÔģĩÁūÐÐĘŧËŲķČĩÄđĀžÆĢŽŋÉŌÔžėēâģöĩąĮ°ĩÄÓĩČûŨīŋöĄĢŋŠĘžĘąĢŽļũļöģĩĩĀķžąČ―ÏÍĻģĐĢŽģĩÁūÃŧÓÐķÂČûĩÄÏÖÏóĢŽÏĩÍģŨũģöÅÐķÏĢŽÏÔĘūÏāÓĶĩÄÔēČĶūųΊÂĖÉŦĄĢŌŧķÎĘąžäŌÔšóĢŽģĩĩĀŌŧŋŠĘžÓĩČûĢŽËæŨÅģĖķČĩÄēŧķÏÔöžÓĢŽķÔÓĶĩÄÏÔĘūÔēČĶŋŠĘžŌŧļöŌŧļöąäšėĢŽÖąÖÁËÄļöÔēČĶČŦēŋąäšėĄĢĩąÓĩČûŨīŋöģöÏÖŧš―âĘąĢŽšėÉŦČĶÓÖÖð―ĨąäŧØÂĖÉŦĄĢÆäËüģĩĩĀĩÄīĶĀíđýģĖĀāËÆĄĢÔÚ°ŨĖėĄĒÆÕÍĻĖėÆøŌÔž°ģĩÁūÕýģĢÐÐĘŧĩÄĮéŋöÏÂĢŽļÃÏĩÍģŋÉŌÔīïĩ―90%ŌÔÉÏĩÄžÆĘýŨžČ·ÐÔĢŽķÔÓĩČûÅÐķÏŌēąČ―Ï·ûšÏĘĩžĘĮéŋöĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķāģĩĩĀģĩÁūžÆĘýšÍÓĩČû·ÖÎöđĶÄÜĄĢŧÃæ·ÖÉÏÏÂÁ―ŋéĢŽÏ·―ĘĮĘÓÆĩģĄū°ĢŽÉÏ·―ĘĮĘĩĘąĩÄ―áđûÏÔĘūĢŽÆäÖÐŨóąßĘĮģĩÁūžÆĘý―áđûĢŽÓŌąßĘĮÓĩČû·ÖÎöĩÄ―áđûĄĢļÃģĄū°ÔÚīóÖÓË·ŋÚĘĩĩØÅÄÉãĄĢąūŅÝĘūÕëķÔģĄū°ÖÐĩÄËÄļöÖũŌŠģĩĩĀÉÏÐÐĘđĩÄģĩÁū―øÐÐÍģžÆĢŽĘýÄŋÏÔĘūÔÚķÔÓĶī°ĖåÖÐĄĢļųūÝļũģĩĩĀĩÄžÆĘý―áđûĢŽ―ášÏķÔģĩÁūÐÐĘŧËŲķČĩÄđĀžÆĢŽŋÉŌÔžėēâģöĩąĮ°ĩÄÓĩČûŨīŋöĄĢŋŠĘžĘąĢŽļũļöģĩĩĀķžąČ―ÏÍĻģĐĢŽģĩÁūÃŧÓÐķÂČûĩÄÏÖÏóĢŽÏĩÍģŨũģöÅÐķÏĢŽÏÔĘūÏāÓĶĩÄÔēČĶūųΊÂĖÉŦĄĢŌŧķÎĘąžäŌÔšóĢŽģĩĩĀŌŧŋŠĘžÓĩČûĢŽËæŨÅģĖķČĩÄēŧķÏÔöžÓĢŽķÔÓĶĩÄÏÔĘūÔēČĶŋŠĘžŌŧļöŌŧļöąäšėĢŽÖąÖÁËÄļöÔēČĶČŦēŋąäšėĄĢĩąÓĩČûŨīŋöģöÏÖŧš―âĘąĢŽšėÉŦČĶÓÖÖð―ĨąäŧØÂĖÉŦĄĢÆäËüģĩĩĀĩÄīĶĀíđýģĖĀāËÆĄĢÔÚ°ŨĖėĄĒÆÕÍĻĖėÆøŌÔž°ģĩÁūÕýģĢÐÐĘŧĩÄĮéŋöÏÂĢŽļÃÏĩÍģŋÉŌÔīïĩ―90%ŌÔÉÏĩÄžÆĘýŨžČ·ÐÔĢŽķÔÓĩČûÅÐķÏŌēąČ―Ï·ûšÏĘĩžĘĮéŋöĄĢ

|

ĄĄ |

13ĢŪģĩÁūŌėģĢÐÐΊžėēâÓëąĻūŊ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģģĩÁūÐÐĘŧÐÐΊŌėģĢąĻūŊĩÄđĶÄÜĄĢÏĩÍģÔÚĘĩĘąÂģ°ôĩÄÔËķŊžėēâĄĒļúŨŲšÍĘķąðĩÄŧųīĄÉÏĢŽķÔÎïĖåĩÄÔËķŊÐÅÏĒ―øÐÐ―øŌŧē―·ÖÎöĢŽĘĩÏÖÁËģĩÁū·ĮÕýģĢÐÐĘŧĩÄĘķąðÓëąĻūŊĄĢļÃŅÝĘūģĄū°ÔÚÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÍĢģĩģĄĘĩĩØÅÄÉãĄĢÏĩÍģĘŨÏČÍĻđýąģū°žõģýĖáČĄÔËķŊķÔÏóēĒ―øÐÐļúŨŲšÍÄŋąęĀāÐÍĘķąðĄĢĩąÓÐŌŧÁū°ŨģĩĘŧÉÏČËÐÐĩĀĘąĢŽÏĩÍģŨÔķŊÔÚļÃģĩÖÜΧīōģöÁ―ļöšėÉŦÎĘšÅĢŽēĒ·ĒģöūŊąĻÉųĢŽąíĘūÆäŋÉÄÜÓÐÐÐĘŧÓÐŌėģĢĢŽÐčŌŠŌýÆðđÜĀíČËÔąĩÄŨĒŌâĄĢĩąģĩÁūÍËģöČËÐÐĩĀĩÄšóĢŽÎĘšÅÏûʧĢŽūŊąĻ―âģýĄĢÔŲđýŌŧķÎĘąžäĢŽÓÐŌŧÁūšÚÉŦĩÄÆûģĩŋėËŲÔÚÍĢģĩģĄÉÏÄæÐÐĢŽÏĩÍģÔÚÆäÖÜΧīōģöÁËÁ―ļöšėÉŦūŠĖūšÅĢŽēĒ·ĒģöūŊąĻÉųĢŽąíĘūÆäÐÐĘŧÐÐΊŌŅū·ĒÉúŌėģĢĄĢļÃąĻūŊđĶÄÜĩÄĘĩÏÖĢŽŋÉŌÔÔÚÎÞČËđĪŅēĘÓĩÄĖõžþÏÂŨÔķŊžėēâģĩÁūÎĨÕÂÐÐĘŧĢŽĘĩÏÖļßЧÖĮÄÜĩÄ―ŧÍĻđÜĀíĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģģĩÁūÐÐĘŧÐÐΊŌėģĢąĻūŊĩÄđĶÄÜĄĢÏĩÍģÔÚĘĩĘąÂģ°ôĩÄÔËķŊžėēâĄĒļúŨŲšÍĘķąðĩÄŧųīĄÉÏĢŽķÔÎïĖåĩÄÔËķŊÐÅÏĒ―øÐÐ―øŌŧē―·ÖÎöĢŽĘĩÏÖÁËģĩÁū·ĮÕýģĢÐÐĘŧĩÄĘķąðÓëąĻūŊĄĢļÃŅÝĘūģĄū°ÔÚÖÐŋÆÔšŨÔķŊŧŊŅÐūŋËųÍĢģĩģĄĘĩĩØÅÄÉãĄĢÏĩÍģĘŨÏČÍĻđýąģū°žõģýĖáČĄÔËķŊķÔÏóēĒ―øÐÐļúŨŲšÍÄŋąęĀāÐÍĘķąðĄĢĩąÓÐŌŧÁū°ŨģĩĘŧÉÏČËÐÐĩĀĘąĢŽÏĩÍģŨÔķŊÔÚļÃģĩÖÜΧīōģöÁ―ļöšėÉŦÎĘšÅĢŽēĒ·ĒģöūŊąĻÉųĢŽąíĘūÆäŋÉÄÜÓÐÐÐĘŧÓÐŌėģĢĢŽÐčŌŠŌýÆðđÜĀíČËÔąĩÄŨĒŌâĄĢĩąģĩÁūÍËģöČËÐÐĩĀĩÄšóĢŽÎĘšÅÏûʧĢŽūŊąĻ―âģýĄĢÔŲđýŌŧķÎĘąžäĢŽÓÐŌŧÁūšÚÉŦĩÄÆûģĩŋėËŲÔÚÍĢģĩģĄÉÏÄæÐÐĢŽÏĩÍģÔÚÆäÖÜΧīōģöÁËÁ―ļöšėÉŦūŠĖūšÅĢŽēĒ·ĒģöūŊąĻÉųĢŽąíĘūÆäÐÐĘŧÐÐΊŌŅū·ĒÉúŌėģĢĄĢļÃąĻūŊđĶÄÜĩÄĘĩÏÖĢŽŋÉŌÔÔÚÎÞČËđĪŅēĘÓĩÄĖõžþÏÂŨÔķŊžėēâģĩÁūÎĨÕÂÐÐĘŧĢŽĘĩÏÖļßЧÖĮÄÜĩÄ―ŧÍĻđÜĀíĄĢ

|

ĄĄ |

14ĢŪŌđžäļúŨŲŅÝĘū |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģŌđžäļúŨŲđĶÄÜĄĢŌđžäÔËķŊķÔÏóžėēâÓëļúŨŲĘĮÂģ°ôĩÄÖĮÄÜžāŋØÏĩÍģĩÄŧųąūŌŠĮóÖŪŌŧĢŽŌēĘĮžžĘõÄŅĩãÖŪŌŧĄĢąūÏĩÍģēÉÓÃÏāđØģÉđûĢŽ―ÏšÃĩÄ―âūöÁËÕâļöÄŅĩãÎĘĖâĄĢŅÝĘū°üĀĻČýļöģĄū°ĄĢģĄū°ŌŧĘĮŌđžäÅÄÉãĩÄÖÐŋÆÔšŨÔķŊŧŊËųÄĢĘ――ĖŅ§ÂĨĮ°ĮøÓōĄĢļÃģĄū°ÖÐĢŽÓÐŌŧļöČËīÓīóÂĨĀïÃæŨßģöĀīĢŽÁíÍâŌŧļöČËÔÚīóÂĨĮ°ÅÜē―ĄĢÔÚ―ÏĩÍĩÄķÔąČķČÏÂĢŽÏĩÍģČÔČŧŨžČ·ĩØžėēâģöÕâÁ―ļöÔËķŊķÔÏóĢŽēĒąĢģÖÕýČ·ĩÄļúŨŲĄĢģĄū°ķþĘĮŌđžäÅÄÉãĩÄÖÐđØīåķŦ··ÃæĄĢļÃģĄū°ÏÂĢŽģĩÁūĩÄĩÆđâ―ŦķÔžāŋØēúÉúŌŧķĻĩÄļÉČÅĢŽČŧķøąūÏĩÍģÍŽŅųÄÜđŧŨžČ·ĩØžėēâģöģĩÁūēĒĘĩÏÖÂģ°ôĩÄļúŨŲĄĢŌÔÉÏģĄū°ķžĘĮÓÉŋÉžûđâÉãÏņŧúÅÄÉãĢŽģĄū°ČýÔōĘĮ―üšėÍâÉãÏņŧúÅÄÉãĩÄŌđžäÔ°ĮøĄĢŋÉŌÔŋīģöąūÏĩÍģŋŠ·ĒĩÄžėēâšÍļúŨŲžžĘõÍŽŅųŋÉŌÔĘĘÓÃÓÚÕâÖÖģĄū°ĢŽūßÓÐ―ÏļßĩÄĘĩĘąÐÔšÍŨžČ·ÐÔĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģŌđžäļúŨŲđĶÄÜĄĢŌđžäÔËķŊķÔÏóžėēâÓëļúŨŲĘĮÂģ°ôĩÄÖĮÄÜžāŋØÏĩÍģĩÄŧųąūŌŠĮóÖŪŌŧĢŽŌēĘĮžžĘõÄŅĩãÖŪŌŧĄĢąūÏĩÍģēÉÓÃÏāđØģÉđûĢŽ―ÏšÃĩÄ―âūöÁËÕâļöÄŅĩãÎĘĖâĄĢŅÝĘū°üĀĻČýļöģĄū°ĄĢģĄū°ŌŧĘĮŌđžäÅÄÉãĩÄÖÐŋÆÔšŨÔķŊŧŊËųÄĢĘ――ĖŅ§ÂĨĮ°ĮøÓōĄĢļÃģĄū°ÖÐĢŽÓÐŌŧļöČËīÓīóÂĨĀïÃæŨßģöĀīĢŽÁíÍâŌŧļöČËÔÚīóÂĨĮ°ÅÜē―ĄĢÔÚ―ÏĩÍĩÄķÔąČķČÏÂĢŽÏĩÍģČÔČŧŨžČ·ĩØžėēâģöÕâÁ―ļöÔËķŊķÔÏóĢŽēĒąĢģÖÕýČ·ĩÄļúŨŲĄĢģĄū°ķþĘĮŌđžäÅÄÉãĩÄÖÐđØīåķŦ··ÃæĄĢļÃģĄū°ÏÂĢŽģĩÁūĩÄĩÆđâ―ŦķÔžāŋØēúÉúŌŧķĻĩÄļÉČÅĢŽČŧķøąūÏĩÍģÍŽŅųÄÜđŧŨžČ·ĩØžėēâģöģĩÁūēĒĘĩÏÖÂģ°ôĩÄļúŨŲĄĢŌÔÉÏģĄū°ķžĘĮÓÉŋÉžûđâÉãÏņŧúÅÄÉãĢŽģĄū°ČýÔōĘĮ―üšėÍâÉãÏņŧúÅÄÉãĩÄŌđžäÔ°ĮøĄĢŋÉŌÔŋīģöąūÏĩÍģŋŠ·ĒĩÄžėēâšÍļúŨŲžžĘõÍŽŅųŋÉŌÔĘĘÓÃÓÚÕâÖÖģĄū°ĢŽūßÓÐ―ÏļßĩÄĘĩĘąÐÔšÍŨžČ·ÐÔĄĢ

|

ĄĄ |

15ĢŪķŊĖŽģĄū°ÏÂĩÄÖũķŊļúŨŲ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķŊĖŽģĄū°ÏÂÖũķŊļúŨŲđĶÄÜĄĢļÃŅÝĘū°üĀĻČýļöģĄū°ĄĢģĄū°ŌŧĘĮŌŧžÜÕ―ķ·ŧúÔÚŋÕÖÐ―øÐÐļßËŲĖØžž·ÉÐÐĢŽļúŨŲĩÄÄŋąęĘĮÕâžÜ·ÉŧúĄĢÍžÏņĩÄ·ÖąæÂĘąČ―ÏĩÍĢŽÄŋąęšÍąģū°ĩÄķÔąČķČŌēąČ―ÏĩÍĢŽÕâÐĐķžēŧĀûÓÚÖũķŊļúŨŲĩÄĘĩÏÖĄĢ ÕëķÔÕâÐĐÄŅĩãĢŽÎŌÃĮĩÄļúŨŲËã·ĻŋÉŌÔĖáČĄģöÄŋąęĮøąðÓÚąģū°ĩÄđØžüĖØÕũĢŽŌōķøŋÉŌÔŨÔĘžÖÁÖÕŨžČ·ĩØËøķĻ·ÉŧúĄĢģĄū°ķþĘĮŌŧžÜÖąÉý·ÉŧúÔÚŋÕÖÐÅĖÐýĢŽļúŨŲĩÄÄŋąęĘĮÕâžÜ·ÉŧúĄĢšÍģĄū°ŌŧĀāËÆĢŽļÃģĄū°ŌēīæÔÚ·ÖąæÂĘĢŽķÔąČķČĩÍĩÄÎĘĖâĢŽÎŌÃĮĩÄËã·ĻŋÉŌÔÂģ°ôĩØķÔ·Éŧú―øÐÐËøķĻļúŨŲĄĢģĄū°ČýĘĮPETS2005ĖáđĐĩÄŌŧļöēâĘÔÐōÁÐĢŽÉæž°ķŊĖŽģĄū°ÏÂĩÄÄŋąęļúŨŲÎĘĖâĢŽūßÓÐŌŧķĻĩÄĖôÕ―ÐÔĄĢļúŨŲĩÄÄŋąęĘĮËŪÉÏĩÄŌÆķŊÄŋąęĢŽĩÍ·ÖąæÂĘĢŽĩÍķÔąČķČŌÔž°šĢÃæĩÄēĻĖÎķÔļúŨŲļÉČÅšÜīóĄĢÎŌÃĮËã·ĻÔōŋË·þÕâÐĐÄŅĩãĢŽšÜšÃĩÄ―âūöÁËķÔļÃÄŋąęĩÄŨžČ·ļúŨŲĢŽÓÃĘŪŨÖŋōĘĩĘąŨžČ·ĩØąęģöÄŋąęÎŧÖÃĢŽēĒļøģöÆäÔËķŊđėžĢĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģĩÄķŊĖŽģĄū°ÏÂÖũķŊļúŨŲđĶÄÜĄĢļÃŅÝĘū°üĀĻČýļöģĄū°ĄĢģĄū°ŌŧĘĮŌŧžÜÕ―ķ·ŧúÔÚŋÕÖÐ―øÐÐļßËŲĖØžž·ÉÐÐĢŽļúŨŲĩÄÄŋąęĘĮÕâžÜ·ÉŧúĄĢÍžÏņĩÄ·ÖąæÂĘąČ―ÏĩÍĢŽÄŋąęšÍąģū°ĩÄķÔąČķČŌēąČ―ÏĩÍĢŽÕâÐĐķžēŧĀûÓÚÖũķŊļúŨŲĩÄĘĩÏÖĄĢ ÕëķÔÕâÐĐÄŅĩãĢŽÎŌÃĮĩÄļúŨŲËã·ĻŋÉŌÔĖáČĄģöÄŋąęĮøąðÓÚąģū°ĩÄđØžüĖØÕũĢŽŌōķøŋÉŌÔŨÔĘžÖÁÖÕŨžČ·ĩØËøķĻ·ÉŧúĄĢģĄū°ķþĘĮŌŧžÜÖąÉý·ÉŧúÔÚŋÕÖÐÅĖÐýĢŽļúŨŲĩÄÄŋąęĘĮÕâžÜ·ÉŧúĄĢšÍģĄū°ŌŧĀāËÆĢŽļÃģĄū°ŌēīæÔÚ·ÖąæÂĘĢŽķÔąČķČĩÍĩÄÎĘĖâĢŽÎŌÃĮĩÄËã·ĻŋÉŌÔÂģ°ôĩØķÔ·Éŧú―øÐÐËøķĻļúŨŲĄĢģĄū°ČýĘĮPETS2005ĖáđĐĩÄŌŧļöēâĘÔÐōÁÐĢŽÉæž°ķŊĖŽģĄū°ÏÂĩÄÄŋąęļúŨŲÎĘĖâĢŽūßÓÐŌŧķĻĩÄĖôÕ―ÐÔĄĢļúŨŲĩÄÄŋąęĘĮËŪÉÏĩÄŌÆķŊÄŋąęĢŽĩÍ·ÖąæÂĘĢŽĩÍķÔąČķČŌÔž°šĢÃæĩÄēĻĖÎķÔļúŨŲļÉČÅšÜīóĄĢÎŌÃĮËã·ĻÔōŋË·þÕâÐĐÄŅĩãĢŽšÜšÃĩÄ―âūöÁËķÔļÃÄŋąęĩÄŨžČ·ļúŨŲĢŽÓÃĘŪŨÖŋōĘĩĘąŨžČ·ĩØąęģöÄŋąęÎŧÖÃĢŽēĒļøģöÆäÔËķŊđėžĢĄĢ

|

ĄĄ |

ĄĄ

16ĢŪĘÓÆĩÍžÏņÐōÁÐÆī―Ó

ĄĄ |

|

ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģ ķÔÍžÏņÓëĘÓÆĩÐōÁÐĩÄČŦū°Æī―ÓđĶÄÜĢŽ―ŦķÔÖÜΧŧ·ūģÁŽÐøÅÄÉãĩÄÍžÏņĘÓÆĩÐōÁÐÆī―ÓģÉČŦū°ÍžÏņĄĢ ĘÓÆĩÏÂÔØ ŅÝĘūąūÏĩÍģ ķÔÍžÏņÓëĘÓÆĩÐōÁÐĩÄČŦū°Æī―ÓđĶÄÜĢŽ―ŦķÔÖÜΧŧ·ūģÁŽÐøÅÄÉãĩÄÍžÏņĘÓÆĩÐōÁÐÆī―ÓģÉČŦū°ÍžÏņĄĢ |

ĄĄ |

ĄĄ

ĄĄ

ĄĄ

ŧØĩ―CBSRÖũŌģ ŧØĩ―CBSRÖũŌģ |